GPT Image2 はネットワーク全体をリフレッシュしますが、なぜ効果がこれほど優れているのでしょうか?研究リーダーのChen Boyuan氏は、基礎となるアーキテクチャが完全に再構築されたことを明らかにしました。しかし、同氏は拡散モデルを使用したのか、自己回帰技術を使用したのかについては答えることを拒否し、不可解にもそれを「普遍モデル」または「画像分野のGPT」と説明しただけだった。

Chen Boyuan 氏のツイートでは、昨年 12 月末の GPT Image 1.5 からこれほど大きな改善を達成するのにわずか 4 か月しかかからなかったことも明らかになりました。

このような画期的な成果を達成するために、コアチームには 13 人しかいません。

チーム全体のリーダーであるガブリエル・ゴー氏は、AIチームメンバーの家族写真を投稿した。

コメント欄の一部のネチズンは「なぜ彼らはアジア人ばかりなの?」と嘆いた。

Chen Boyuan: Python を知らなかった状態から研究リーダーに

GPT Image 2 のアーキテクチャとは正確には何ですか?

OpenAI は長い間発表されないかもしれませんが、コア チーム メンバーの学術的経験からいくつかの痕跡を見ることができます。

Chen Boyuan はチームの研究主任です。彼ともう一人のメンバーであるキファン・ソンは、博士号取得の勉強をしていたとき、同じ指導者ヴィンセント・シッツマンに師事していました。 MITで。

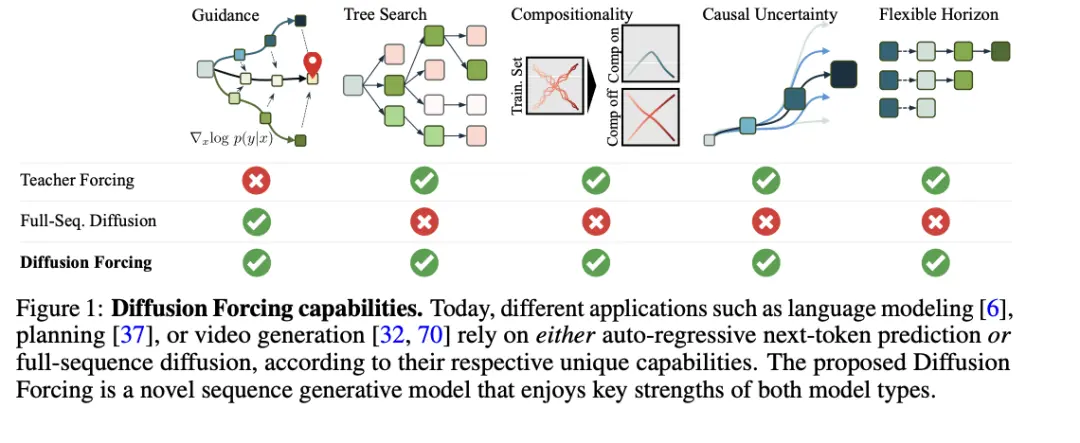

博士課程時代の彼の傑作「Diffusion Forcing: Next-token Prediction Meets Full-Sequence Diffusion」が NeurIPS 2024 に選ばれました。

この研究では、トークンごとの独立したノイズ レベル拡散と因果的な次のトークン予測を組み合わせた新しいシーケンス生成トレーニング パラダイムである拡散強制を提案し、自己回帰モデルの可変長生成と完全シーケンス拡散モデルの長距離誘導の利点を統合します。

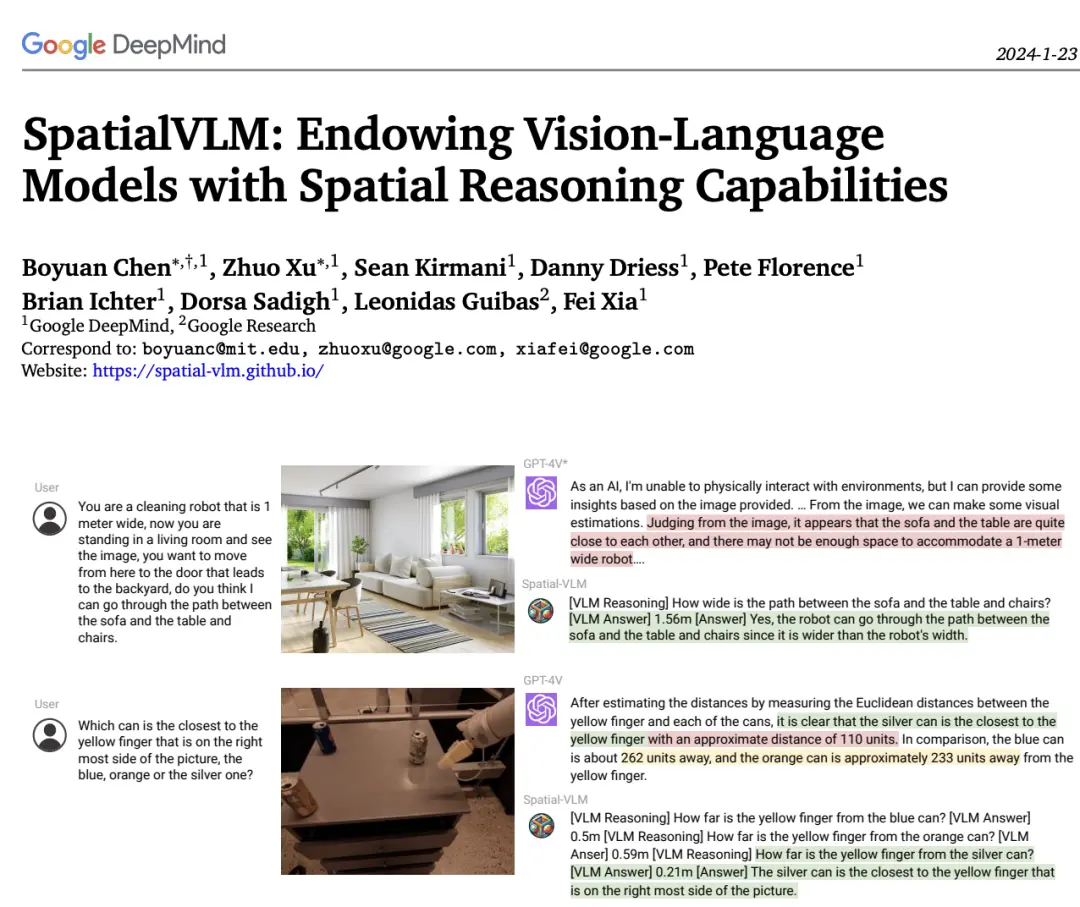

Google でのインターンシップ中に、共著者として SpatialVLM も出版しました。

インターネット規模の 3D 空間推論 VQA データセット (1,000 万画像、20 億 QA ペア) を自動的に構築することで、視覚言語モデルに定量的/定性的な空間推論機能が与えられ、単一の 2D 画像からメートル距離、サイズ、向きなどの正確な値を出力できます。

この研究は、思考連鎖空間推論を身体化された知能の分野に適用します。

Google でのインターンシップ中に、彼が開発した命令微調整テクノロジーは、後に Gemini 2.0 に採用されました。

高校の科学研究サマーキャンプに参加したとき、彼は Python の基本的な構文を理解していませんでした。その時に出会った Google DeepMind の上級研究員である Xia Fei 氏に AI の世界を紹介されました。

Xia Fei は、DeepMind で質の高いインターンシップを完了するよう彼を 2 度招待しました。これらの経験により、Chen Boyuan は大規模モデル トレーニングにおけるエンジニアリング経験を蓄積することができ、また、マルチモーダル システムのデータ要件を理解するための貴重な視点も得ました。

博士号を取得して卒業した後、Chen Boyuan は 2025 年 6 月に OpenAI に入社し、すぐに GPT 画像生成の 5 人の中心メンバーの 1 人になりました。彼は GPT 画像生成モデルのすべてのトレーニングを担当し、Sora ビデオ生成チームのメンバーでもありました。

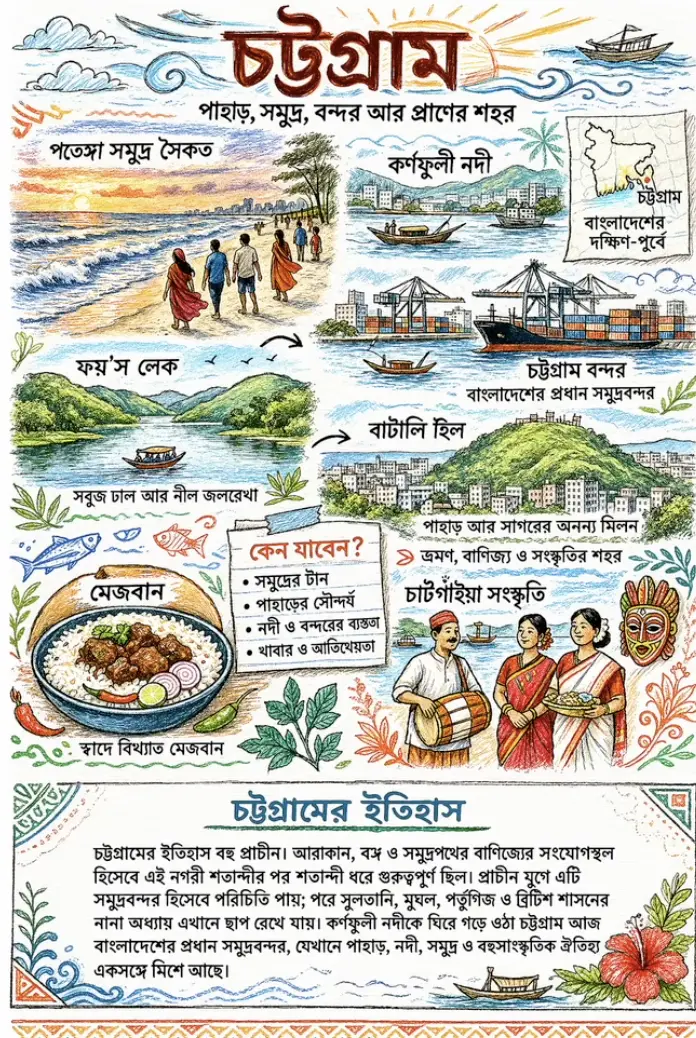

デモンストレーションでは、故郷の無錫のポスターを作成した。それから、ソウルのチームメイトには韓国語のポスターを、バングラデシュのチームメイトにはベンガル語のポスターを作りました。それぞれのテキストのレンダリングは正確です。

中国科学技術大学 Jianfeng Wang: Shengtu AI に世界の知識を理解させよう

Jianfeng Wang 氏は博士号を取得して卒業しました。中国科学技術大学出身の彼は、GPT Image 2 チームのもう 1 つの驚くべき能力、つまり指示に従うことと世界を理解することを担当しています。

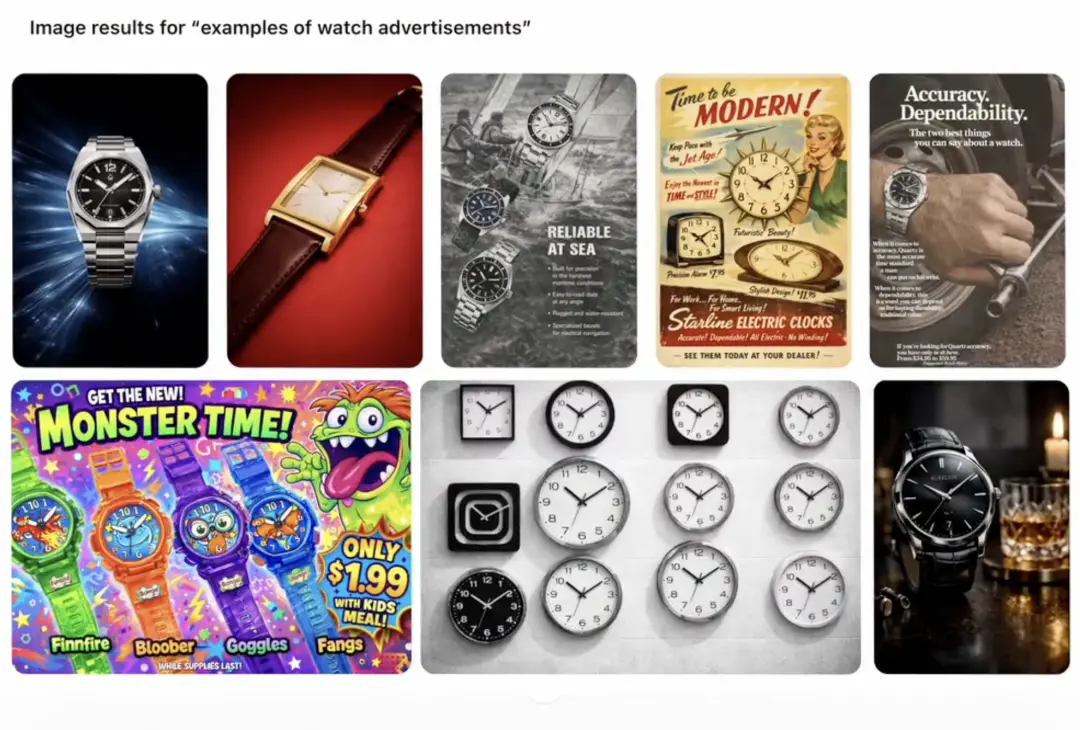

旧モデルが描く永遠の時計は常に10時10分を指していますが、これはインターネット上の時計広告画像から派生したもので、そのほとんどが10時10分です。

これは、時計メーカーが心理学者と実験を行っており、これが消費者の時計の購入意欲を刺激するのに役立つと考えているためです。

彼は新しいモデルに、2:25、3:30、9:10、7:45 をすべて正確に描くように依頼しました。

これは単なる前菜です。

中央にリンゴ、右側にカップ、上に本、左側にカメラ、下にバスケットボールを配置した、より複雑な空間レイアウト。モデルはすべて正確に実行されます。

OpenAI に入社する前は、マイクロソフトで 9 年近く働いていました。 Microsoft 在籍中に、DALLE-3 に関して OpenAI チームと協力しました。

彼はコンピュータ ビジョンの分野で多くの学術論文を発表しており、その研究内容には画像分類、ターゲット検出、セマンティック セグメンテーション、および視覚表現学習が含まれる可能性があります。

世界の知識を理解する能力が大幅に向上し、オブジェクトの意味内容と機能構造が正しく理解されるようになりました。

JianFeng Wang 氏はデモ ビデオの最後で、「GPT Image 2 はユーザーの意図とモデルの出力との間のギャップを解消します」と述べました。

本当にやりたいことをやれば、モデルはあなたが望むものを与えてくれるでしょう。

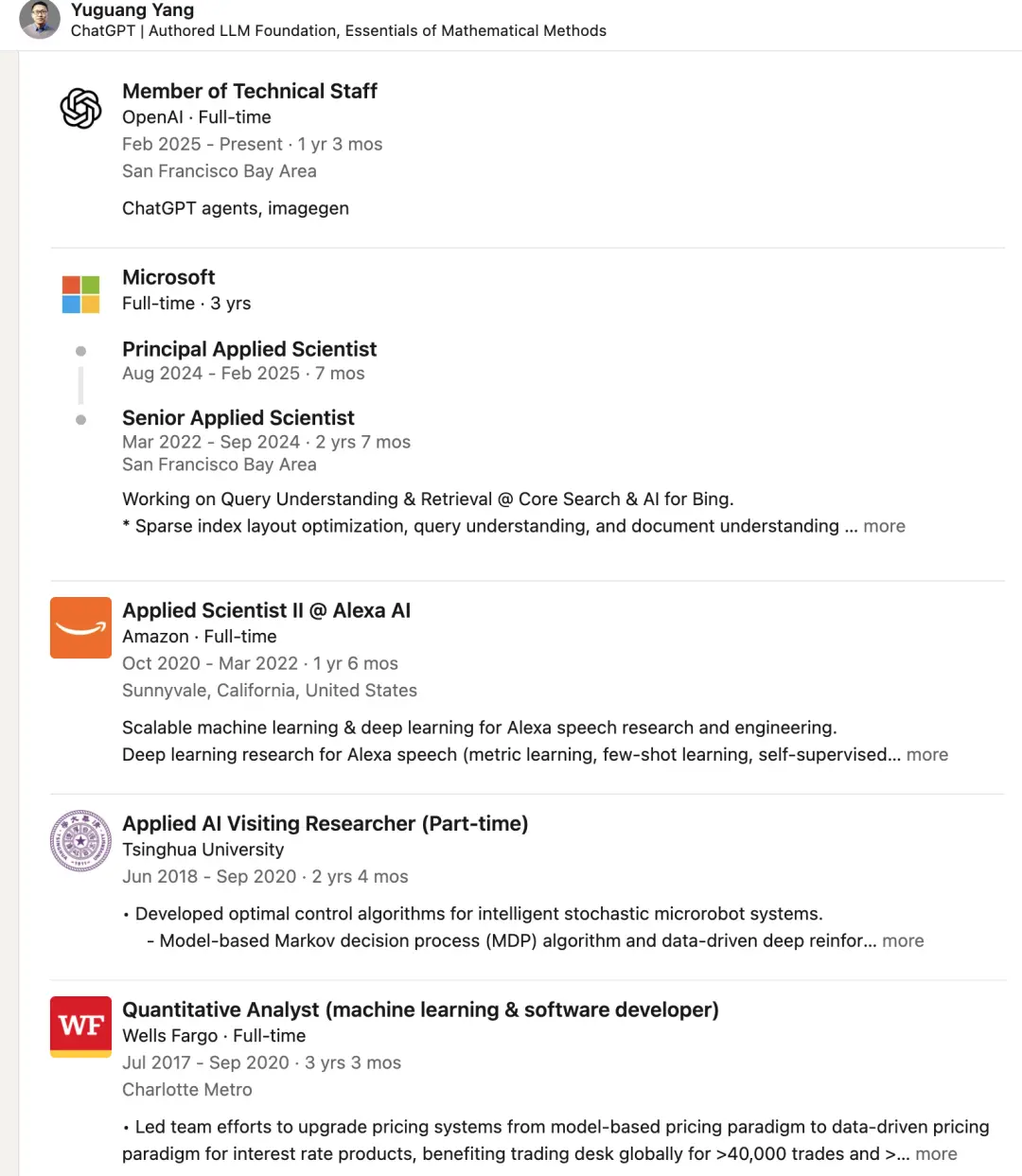

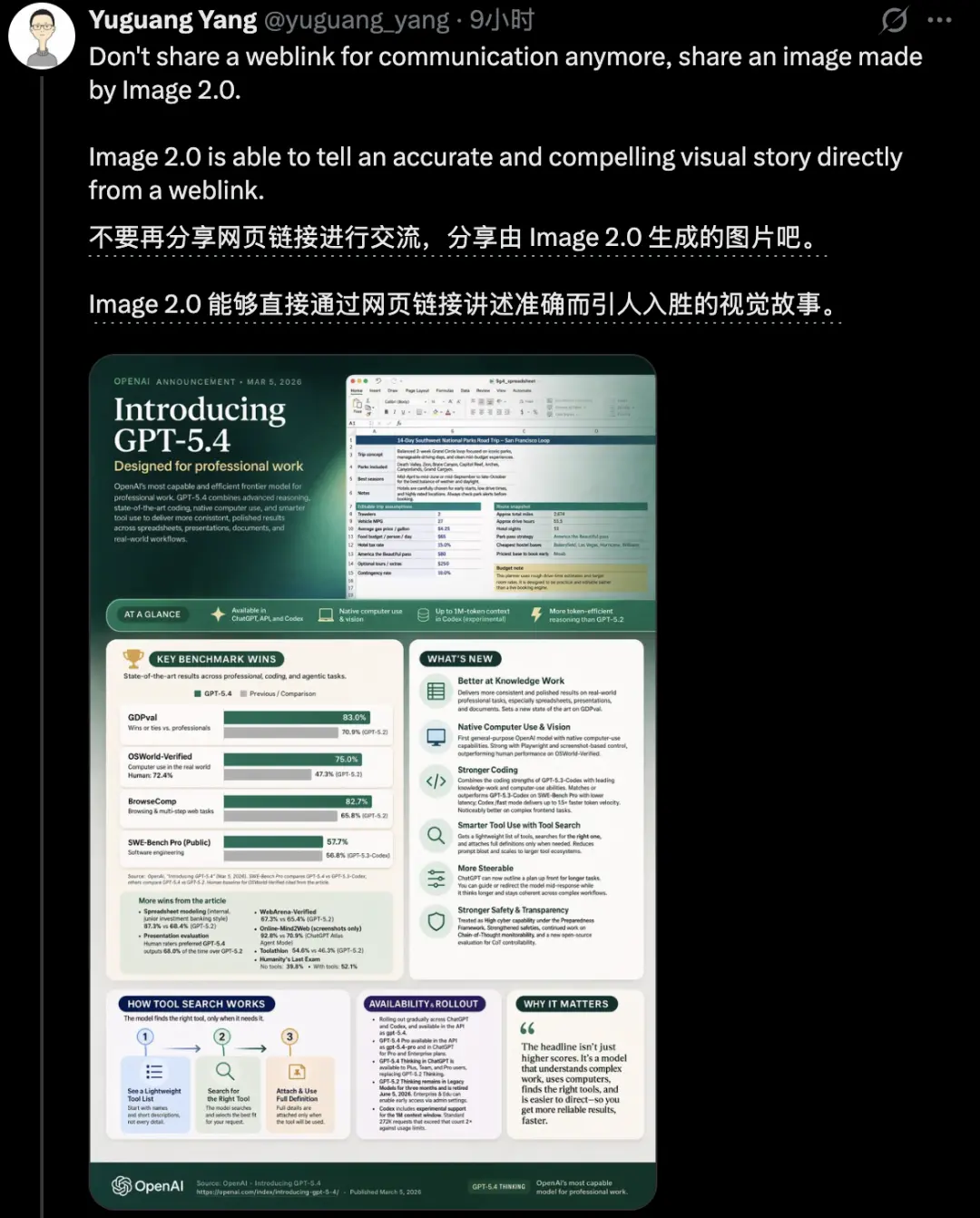

Yuguang Yang: 高精度の複雑な情報グラフィックの生成

Yuguang Yang は、GPT Image 2 の発表イベントでインフォグラフィックスと PPT の生成をデモンストレーションしました。

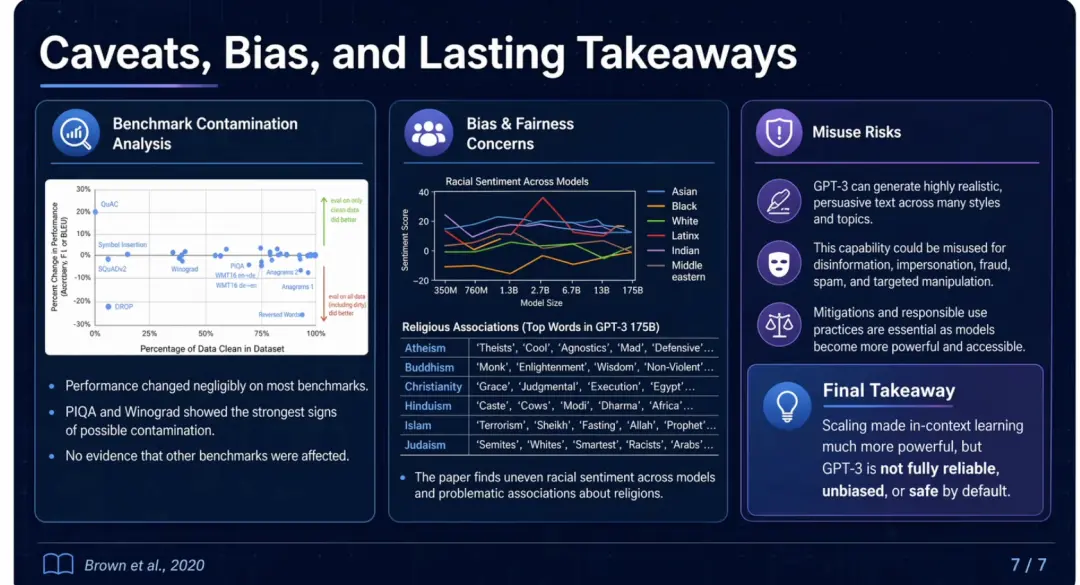

75 ページの GPT-3 論文全体を ChatGPT にドラッグすると、7 枚のスライドが自動的に生成されます。

彼の経験はチームメンバーの中で最も豊富であると言える。彼が受ける仕事はすべて国境を越えたものですが、それらはすべて機械学習に焦点を当てています。

彼は、浙江大学朱科鎮学院で工学を学び、学士号を取得し、博士課程では計算化学物理学と機械学習を研究しました。ジョンズ・ホプキンス大学で。

彼の最初のフルタイムの仕事は定量アナリストでした。ヤニウ氏は清華大学で客員研究員として働きながら、ナノロボットの強化学習と制御アルゴリズムに取り組んだ。

その後、彼は Amazon で Alexa 音声の研究を行いました。

Microsoft では、Bing 検索クエリの理解と取得、およびドキュメントの理解にも取り組みました。

2025 年初めに OpenAI に入社した後、画像生成に加えて、ChatGPT エージェント プロジェクトにも参加しました。

彼は、科学研究者の時間を大幅に節約できる GPT Image 2 のインフォグラフィック生成機能を個人アカウントで紹介しました。

また、インフォグラフィックを作成するときは、思考モードを選択することを忘れないようにと繰り返し注意しています。

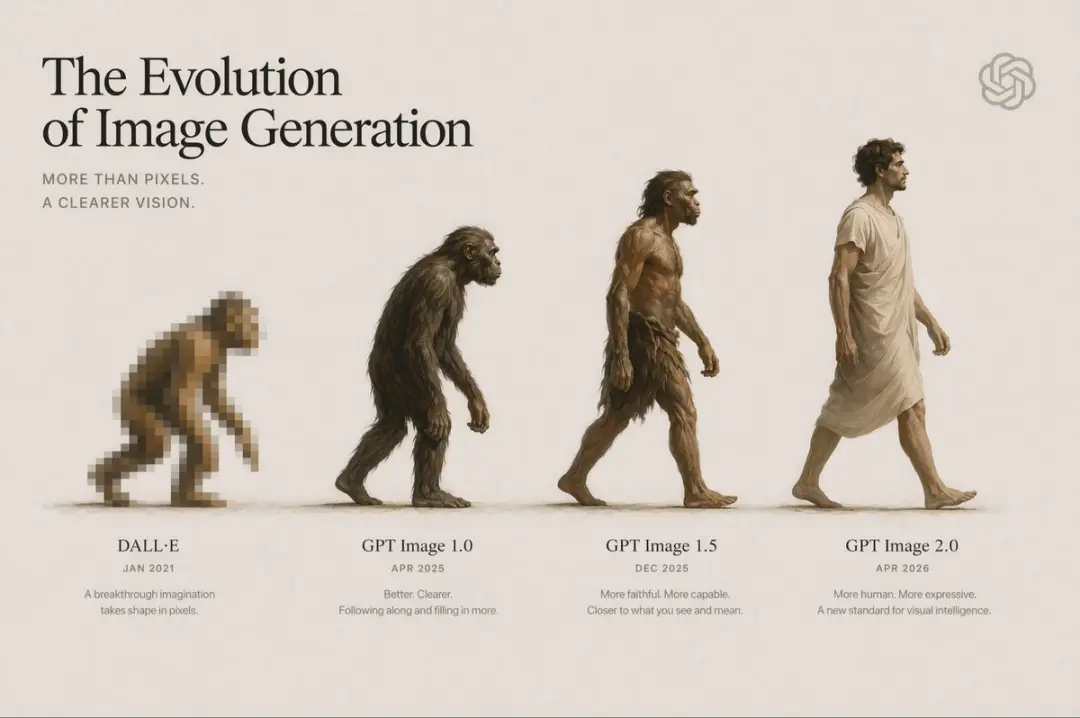

DALL-E から GPT イメージ 2.0 へ

チームメンバーの畑健二さんの自己紹介から、GPT Image 1.0がGPT-4oの画像生成部分であることが分かりました。

DALL-E 以来、OpenAI マルチモーダル シリーズの研究全体に参加している人が 1 人います。

彼は GPT Image 2.0 チームのリーダーである Gabriel Goh です。

2019 年に OpenAI に参加して以来、彼の初期の研究はより理論的なものであり、解釈可能性、凸最適化などに焦点を当てていました。

DALL-Eからスタートして、徐々に画像生成に目を向けていきました。

別のチームメンバー Weixin Liang の研究履歴を見ると、GPT Image 2 の技術的背景が明らかになりました。

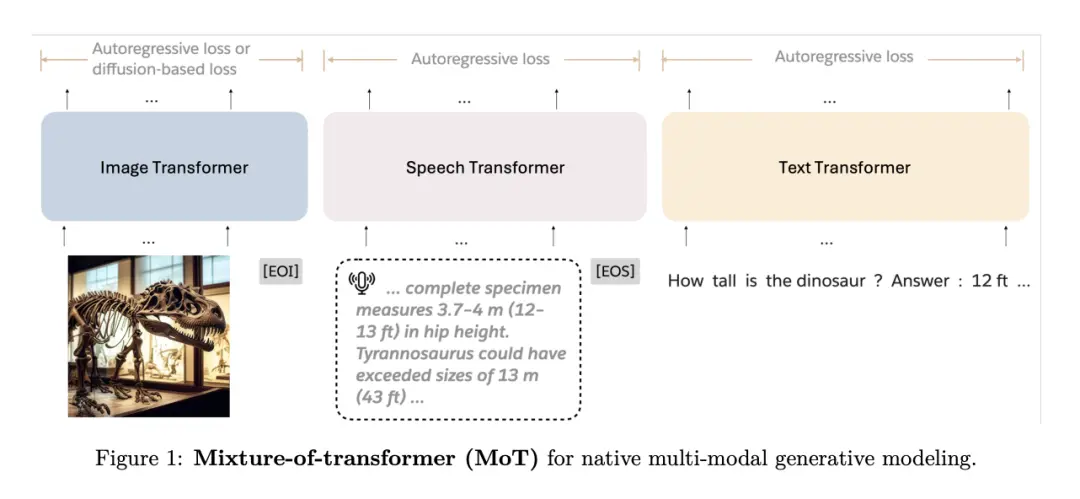

Meta でのインターンシップ中の彼の代表的な作品である Mixture-of-Transformers は、モーダル デカップリング MoE と注意の分離を導入し、マルチモーダル モデルの事前トレーニングの計算コストを大幅に削減しました。

彼はスタンフォード大学で博士号を取得し、浙江大学朱克鎮学院で学士号を取得して卒業したが、楊雨光より数年遅れた。

Weixin Liang 氏は、Chen Boyuan 氏と同様に、2 人とも 25 年間の博士号を取得しています。卒業後すぐに OpenAI に入社し、すぐにチームの中心メンバーになりました。

その他の GPT Image 2.0 チーム メンバーは次のとおりです。

以前 Luma AI で働いていたAyaan Haque 氏は、Luma の基本的なビデオ生成モデルである Dream Machine のトレーニングに参加しました。

Bing Liang は Google で 5 年以上勤務し、Imagen3、Veo、Gemini Multimodal に参加しています。 2025 年に、彼は画像生成の研究を行うために OpenAI に飛び込みました。

Mengchao Zhong は上海交通大学の卒業生で、テキサス A&M 大学で学士号と修士号を取得しています。彼は Pinterest と Airtable でソフトウェア エンジニアとして働いており、OpenAI ではマルチモーダル プロダクト エンジニアリングを担当しています。

Dibya Bhattacharjee、イェール大学、2015 年 IPhO 銅メダル、CIE A レベルの数学と生物学で世界最高得点。

Kiwhan Song 氏は、2025 年 10 月に最後に加わった人物です。彼は研究を行うことに加えて、チーム内での即席の言葉の達人でもあります。あなたが目にする公式のデモンストレーション写真の多くは彼によるものです。

…

初期の DALL-E から今日の GPT Image 2.0 に至るまで、このチームは次々と問題を解決してきました。くっきり描ける、美しく描ける、正確に描ける。

近年、OpenAI の人材の流れは素晴らしいですが、OpenAI は依然としてさまざまな個性を持つ人材を引き付けることができ、専攻を限定せず、国境を越えた研究を歓迎し、ボトムアップの創発的研究を信じている会社です。

小さなチームからスタートし、画期的な進歩が見られた後、同社は世界を変えるまでさらに多くのリソースを投入します。

もうひとつ

かつて、GPT-4o 画像生成は、ジブリ風のアバターを模倣して世界を席巻しました。

GPT Image 2.0 のチーム メンバーは全員、アバターをこの奇妙な首のスタイルに変更しました。

では、この画風のヒントは何でしょうか?チームメンバーも発表

Use my photo only for identity. Redraw me as a very simple surreal Japanese sticker-style caricature: long thin neck, small deadpan face, minimal black outline, flat light coloring, almost no shading, very few facial details, simplified hair shape, lots of white space, plain white background, slightly awkward and funny. Ultratall 1:3 image.

参考リンク:

[1]https://x.com/gabeeegoooh/status/2046674385407512687?s=20

[2]https://venturebeat.com/technology/openais-chatgpt-images-2-0-is-here-and-it-does-multilingual-text-full-infographics-slides-maps-even-manga-seemingly-flawless