本日、Ant Bailing は Ling-2.6-flash を正式に発表しました。これは、合計パラメータ ボリュームが 104B、アクティベーション パラメータが 7.4B の Instruct モデルです。このモデルは「トークンの効率」に焦点を当てています。競争力のあるインテリジェンス レベルを維持しながら、より高速で経済的であり、大規模な実際のアプリケーションにより適しています。

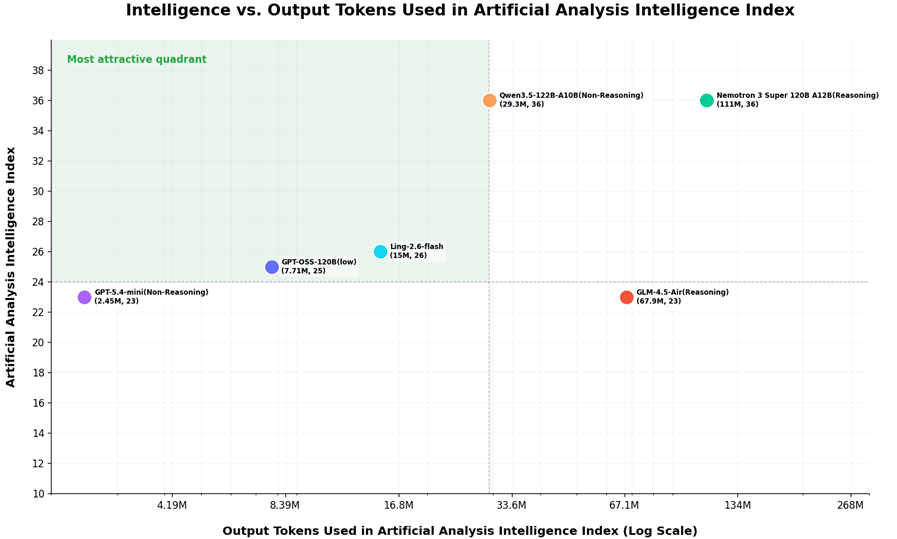

信頼できる第三者評価の人工分析データによると、Ling-2.6-flash は優れたトークン効率の利点を示し、1,500 万の出力トークンで 26 ポイントのインテリジェンス インデックスを達成しながら、出力消費を比較的低い位置で制御しながら強力なレベルのインテリジェンスを維持します。

Ling-2.6-フラッシュは、Ling 2.5 のハイブリッド リニア アーキテクチャ設計に従っていることがわかります。この高度にスパースな MoE アーキテクチャには、ハードウェア パフォーマンスにおいて明らかな利点があります。

4 カード H20 の条件下では、推論速度は最大 340 トークン/秒に達し、プリフィル スループットは Nemotron-3-Super の 2.2 倍に達します。

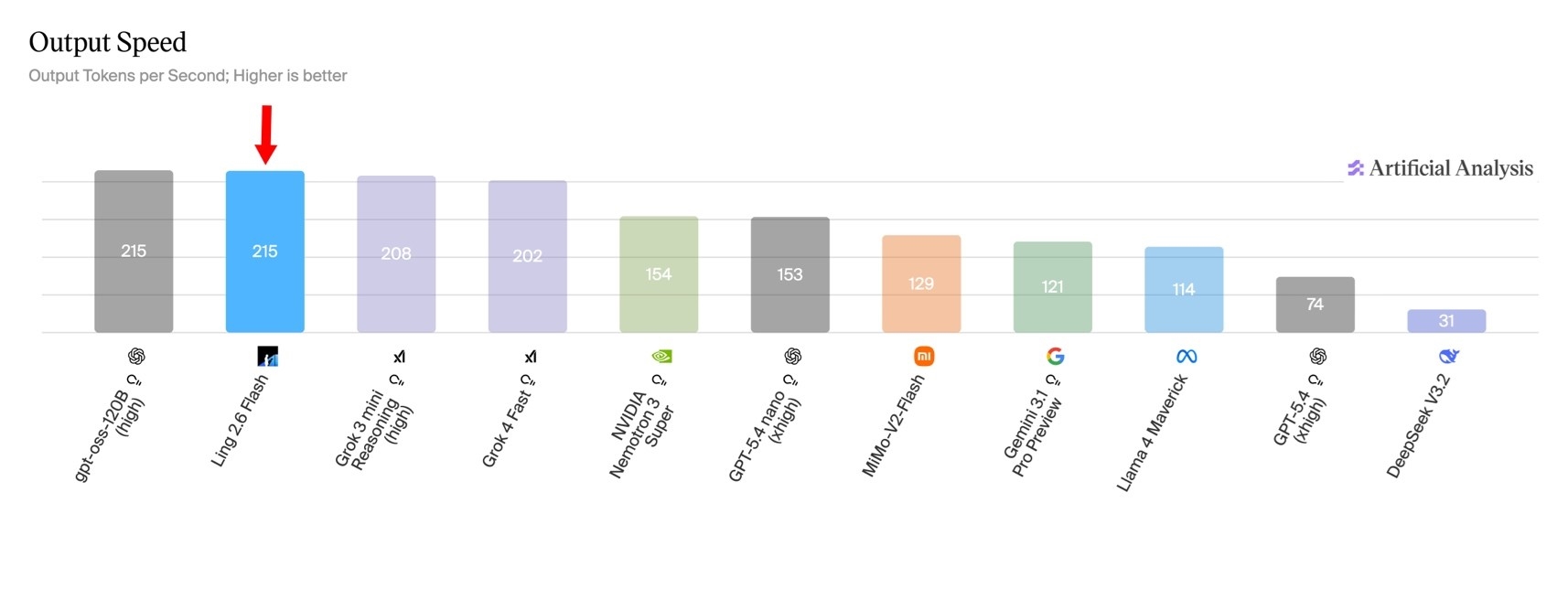

出力速度の評価では、Ling-2.6-flash が 215 トークン/秒の安定した出力速度で、同じパラメータ レベルのモデルの中で 1 位にランクされました。

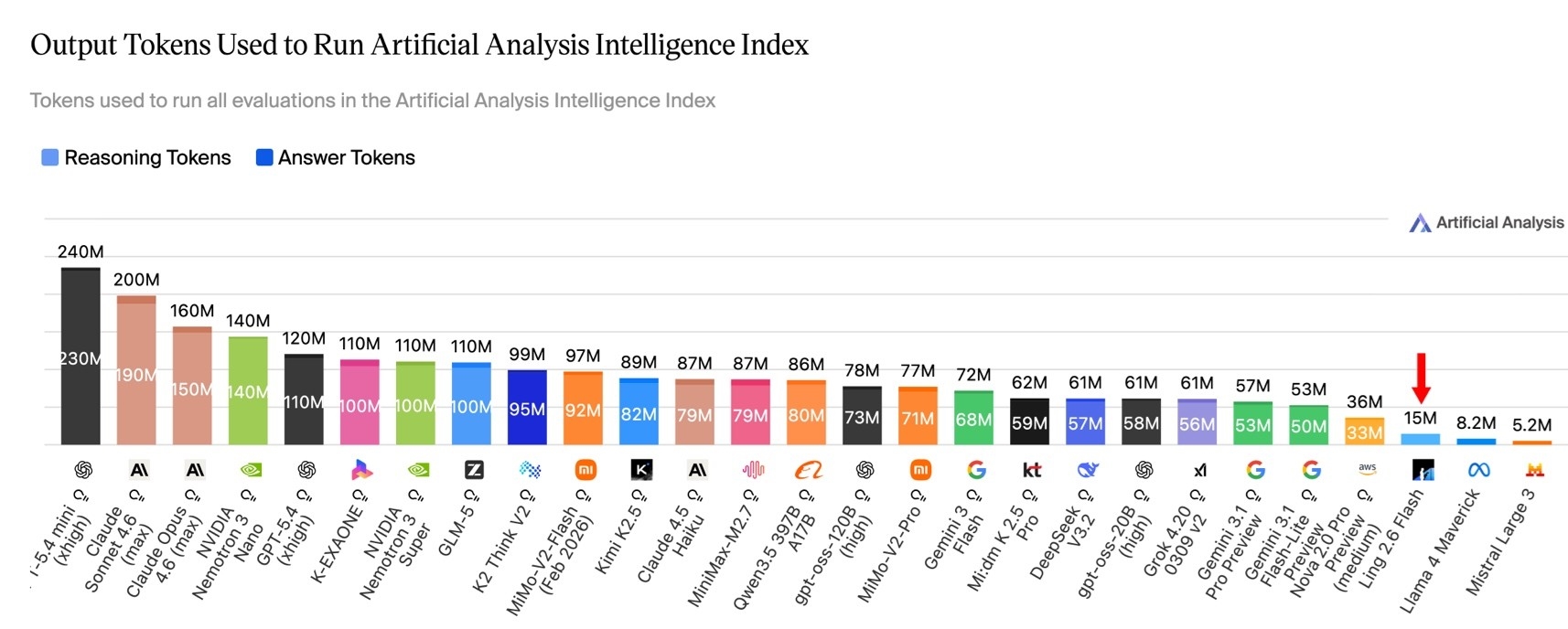

トークン消費の観点から見ると、Ling-2.6-flash の I/O 比率は大幅に向上しました。

人工分析の完全な評価では、Ling-2.6-flash の総消費量は 1,500 万トークンでしたが、Nemotron-3-Super などのモデルは 1 億 1,000 万トークンに達するか、それを超えました。これは、Ling-2.6-flash が同様の評価タスクを完了するためにトークン消費量の約 1/10 のみを使用することを意味します。

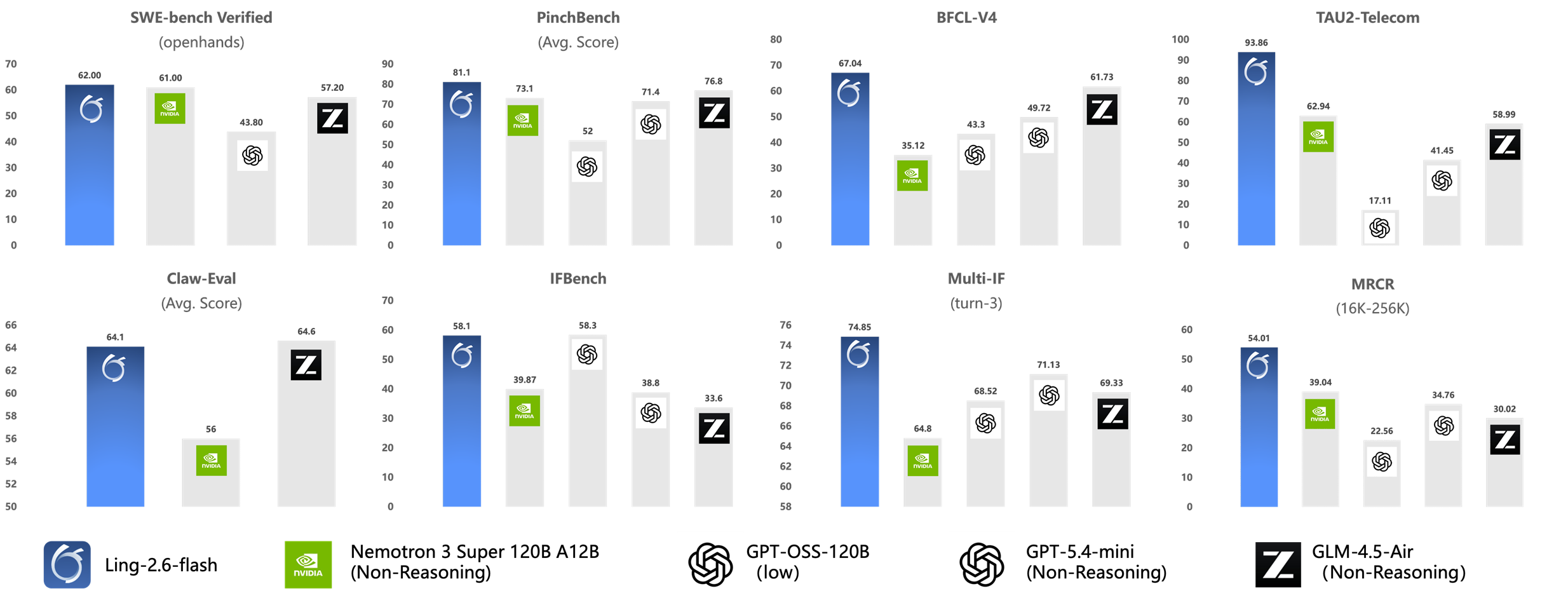

Ling-2.6-flash では、エージェント シナリオ向けに対象を絞った機能強化が行われています。トークンの消費を制御しながら、強力なタスク実行機能を維持します。このモデルは、BFCL-V4、TAU2-bench、SWE-bench Verified、Claw-Eval、PinchBench などのエージェント関連のベンチマークで同じサイズの SOTA レベルに達しています。

同時に、Ling-2.6-flash は、一般知識、数学的推論、命令への従うこと、長いテキストの解析などの面で優れたレベルを維持しています。

API の価格に関しては、Ling-2.6-flash の価格は、入力の場合は 100 万トークンあたり 0.1 米ドル、出力の場合は 0.3 米ドルです。現在、Ling-2.6-flashのAPIは正式にユーザーに公開されており、1週間の期間限定の無料トライアルが提供されています。

ユーザーは、OpenRouter および Bailing 大型モデル tbox を通じて対応するサービスを利用できます。このモデルはその後、世界中の開発者や中小企業にサービスを提供するために、Ant Digital を通じて商用バージョンの LingDT をリリースすることがわかっています。