今年、メモリの価格は 3 ~ 5 倍に上昇しており、PC や携帯電話の消費意欲に深刻な影響を及ぼしています。このメモリ価格の大幅な高騰の原因は、AI に対する強い需要です。 AI にはメモリ (GPU 上のビデオ メモリを含む) の容量と帯域幅に対する非常に高い要件があることは誰もが知っていますが、どれだけの要件を満たすことができるのでしょうか? Google が数日前にリリースした第 8 世代 TPU がその最良の例です。

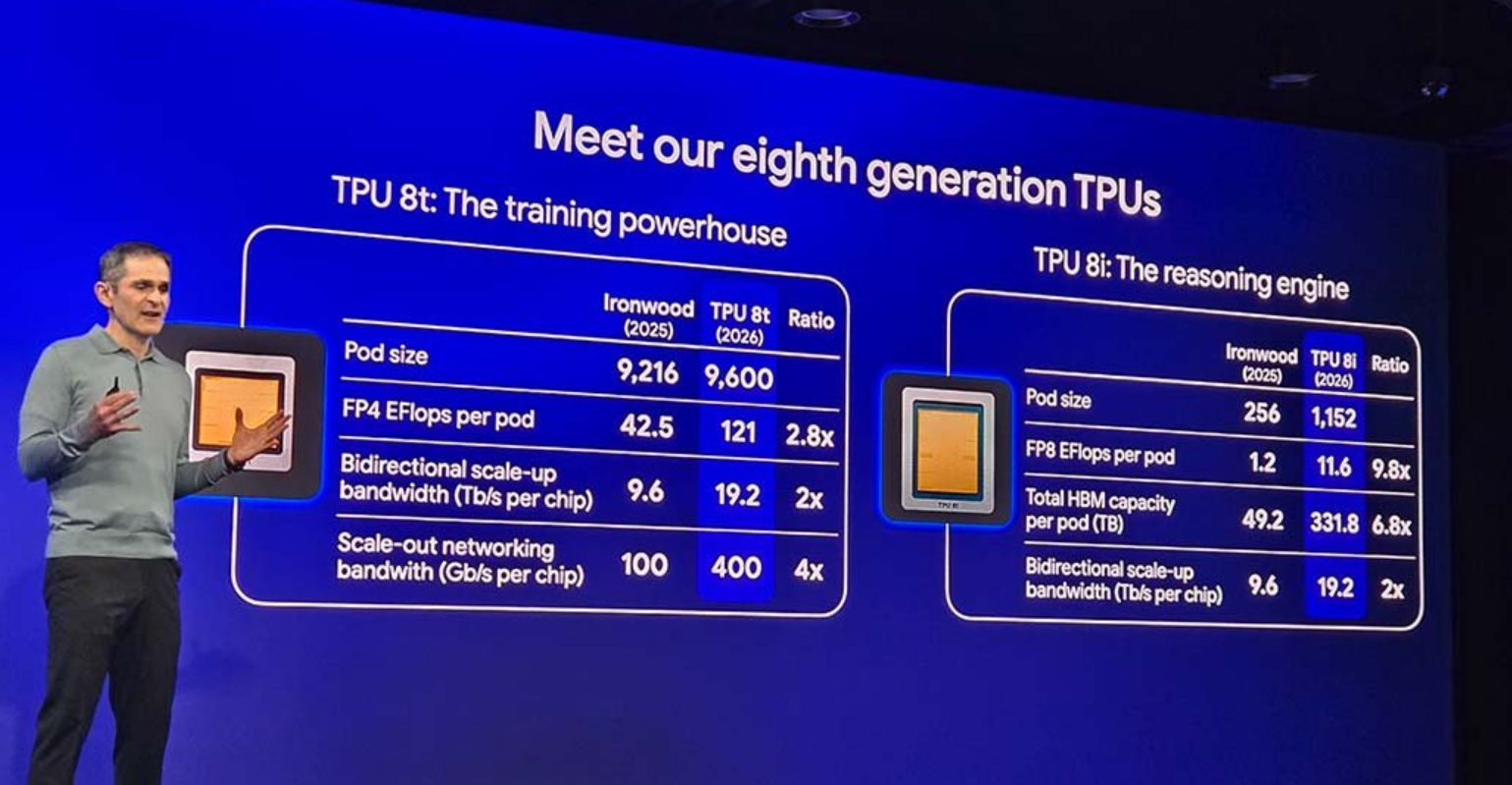

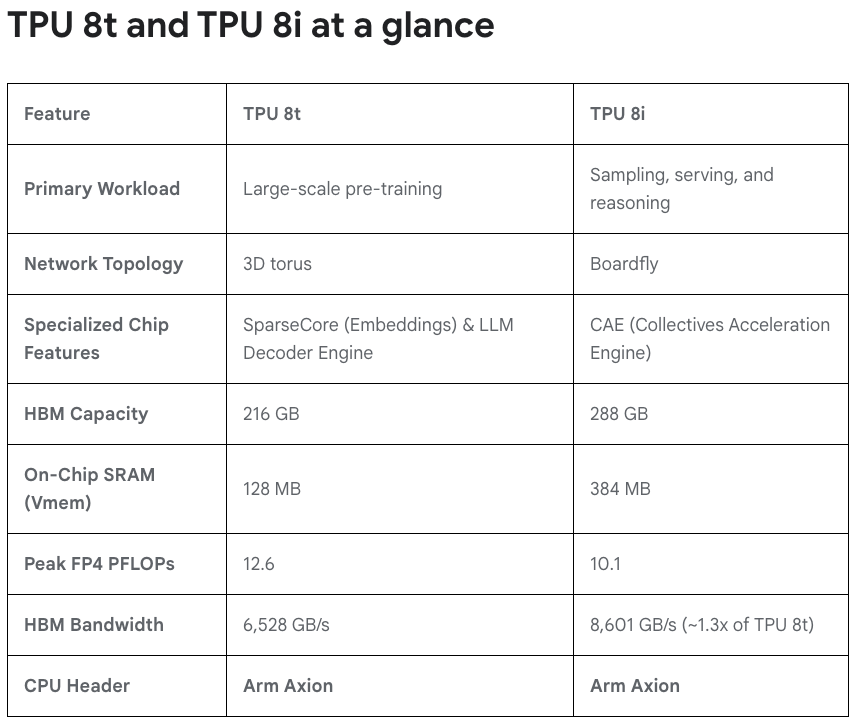

今年の TPU v8 では、トレーニングと推論が初めて区別されます。 V8T は AI トレーニングに重点を置いています。 Googleは推論もできると言っていますが、主にトレーニングに使用されています。各 Pod ノードには 9,600 個の V8T チップがスタックされており、FP4 のパフォーマンスは 121EFlops に達します。、メモリ帯域幅は19.2TB/s、内部チップ帯域幅は400GB/sで、ほぼ2〜4倍の変化です。

V8iは主にAIの推論負荷を目的としており、スペックを大幅に下げる必要がある。各ノードには 1152 個の V8i チップしか搭載されておらず、計算能力は 11.6EFlops に削減され、メモリ帯域幅は 19.2TB/秒のままです。

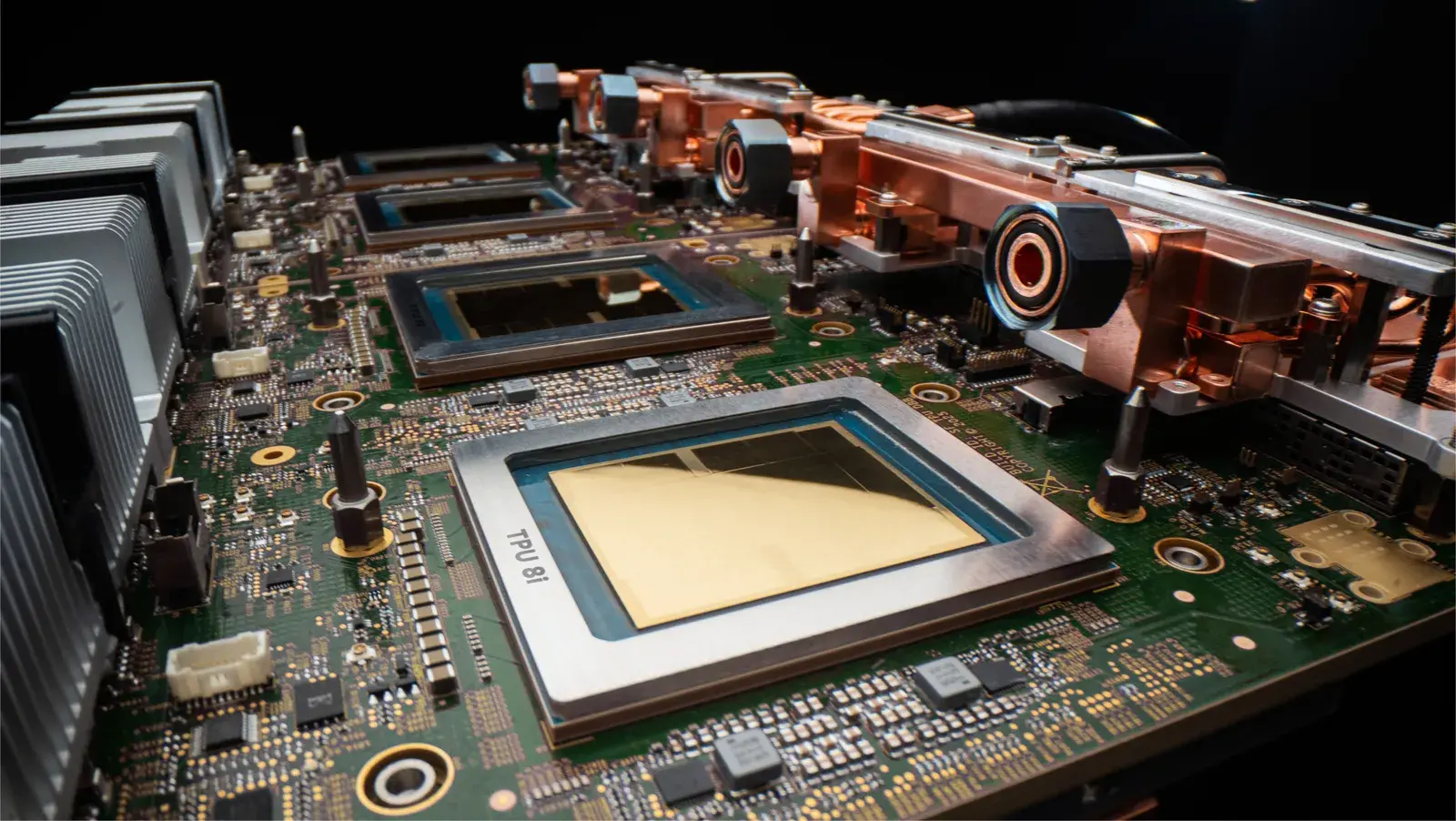

今回注目すべきはメモリ容量が大幅に増加していることだ。V8i は 331.8TB の HBM メモリにも達し、V8T には 2PB の大規模な HBM メモリが搭載されています。各 V8T チップには 216GB HBM メモリが搭載されています。

今回のGoogleの設計コンセプトは、AIのボトルネックであるメモリの壁を突破することだ。 2PB HBM は総容量が非常に大きいだけでなく、ノード内の単一のグローバル アドレスとしても使用されます。 NVIDIA の GPU はこれまで、NVLink などのテクノロジを通じて PB レベルの HBM メモリをスタックできましたが、接続では従来のデータセンター ネットワークをバイパスできず、パフォーマンスと遅延のボトルネックが発生します。

ロバストクラウドの首席コンサルタント、ラリー・カルヴァーリョ氏は、「メモリの壁」の突破は、AIチップ分野におけるグーグルにとって潜在的に大きな競争上の変化を示すものだと述べた。

しかし、一般の人にとって、Google が 2PB HBM メモリを発売したことは良い兆候ではありません。これは、AI のメモリ需要が依然として増加していることを意味するからです。HBM メモリは通常、従来の DDR メモリよりも 2 ~ 4 倍の DRAM チップ生産能力を消費することを知っておく必要があります。HBM が使用されるほど、より多くの DDR メモリ容量が占有されます。

サムスン、SKハイニックス、マイクロンなどの企業は需要が増加してもHBM需要の確保を優先するが、チップ生産能力を大幅に拡大することはないとこれまでに明らかにしていた。メモリチップの不足がさらに深刻になるのは明らかで、価格の急速な低下は期待できない。