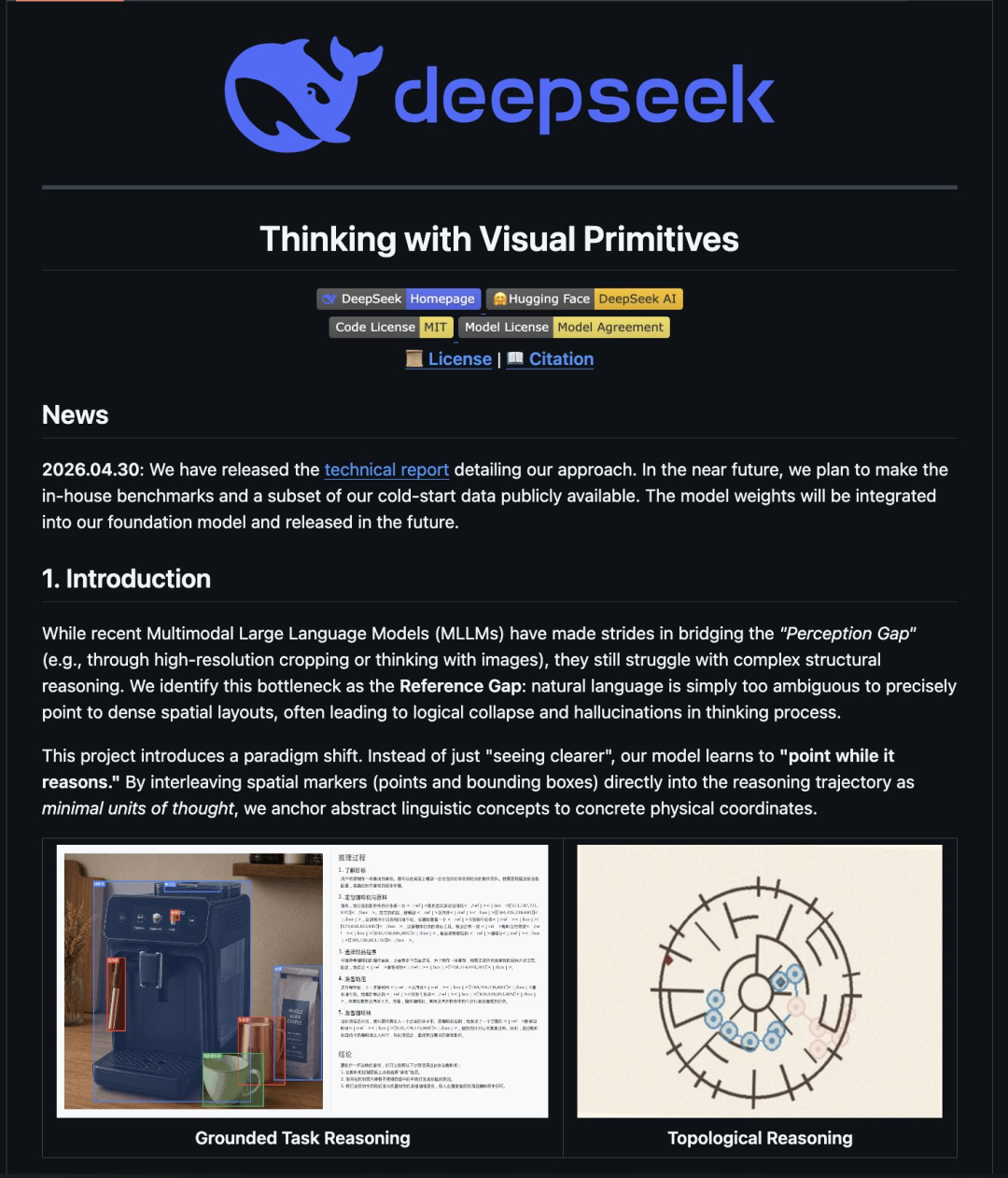

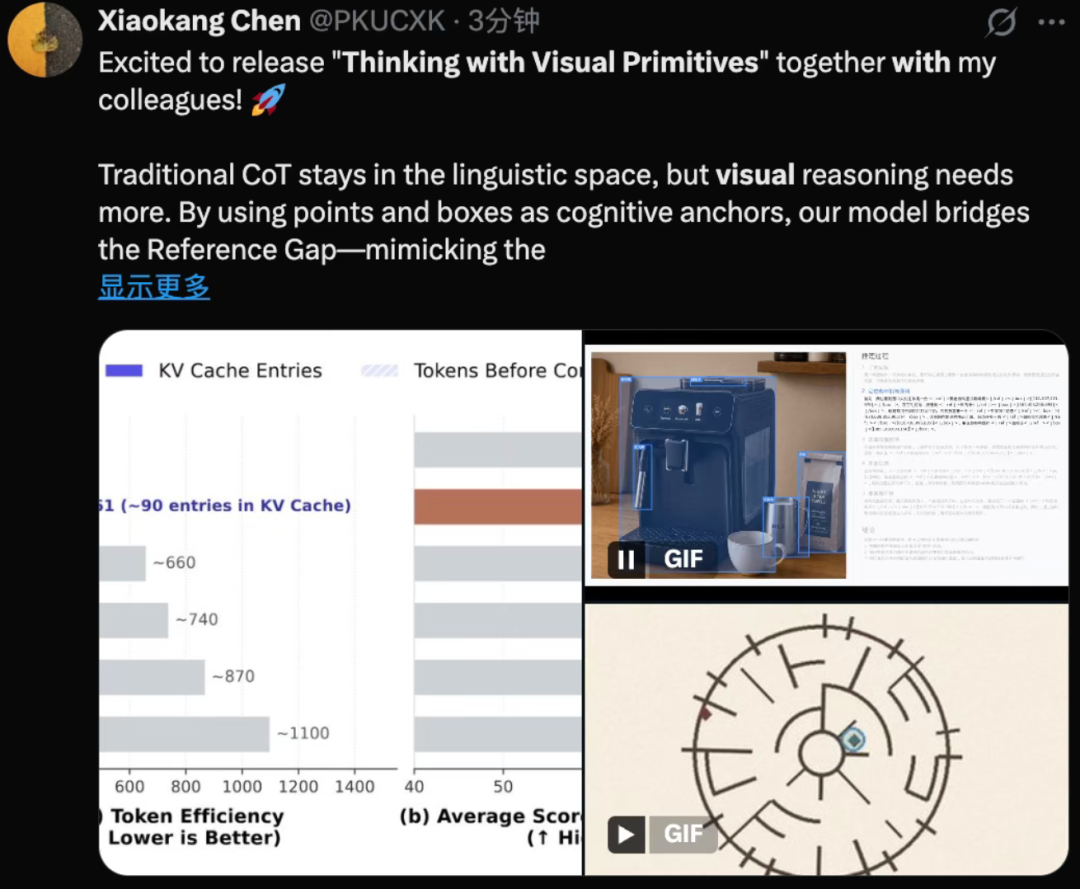

DeepSeekマルチモーダル研究者のChen Xiaokang氏は昨夜Xにツイートを投稿し、マルチモーダル技術に関するDeepSeekの新しい論文「Thinking with Visual Primitives」(「リリースに興奮している」という意味)を発表した。

今朝早く、ツイートは削除され、GitHub上の論文も取り下げられた。

しかし、APPSOは消える前にすべてを読みました。読んでみて、この論文の撤回は内容に問題があるからではないのではないかと感じた。

逆に暴露しすぎかも。

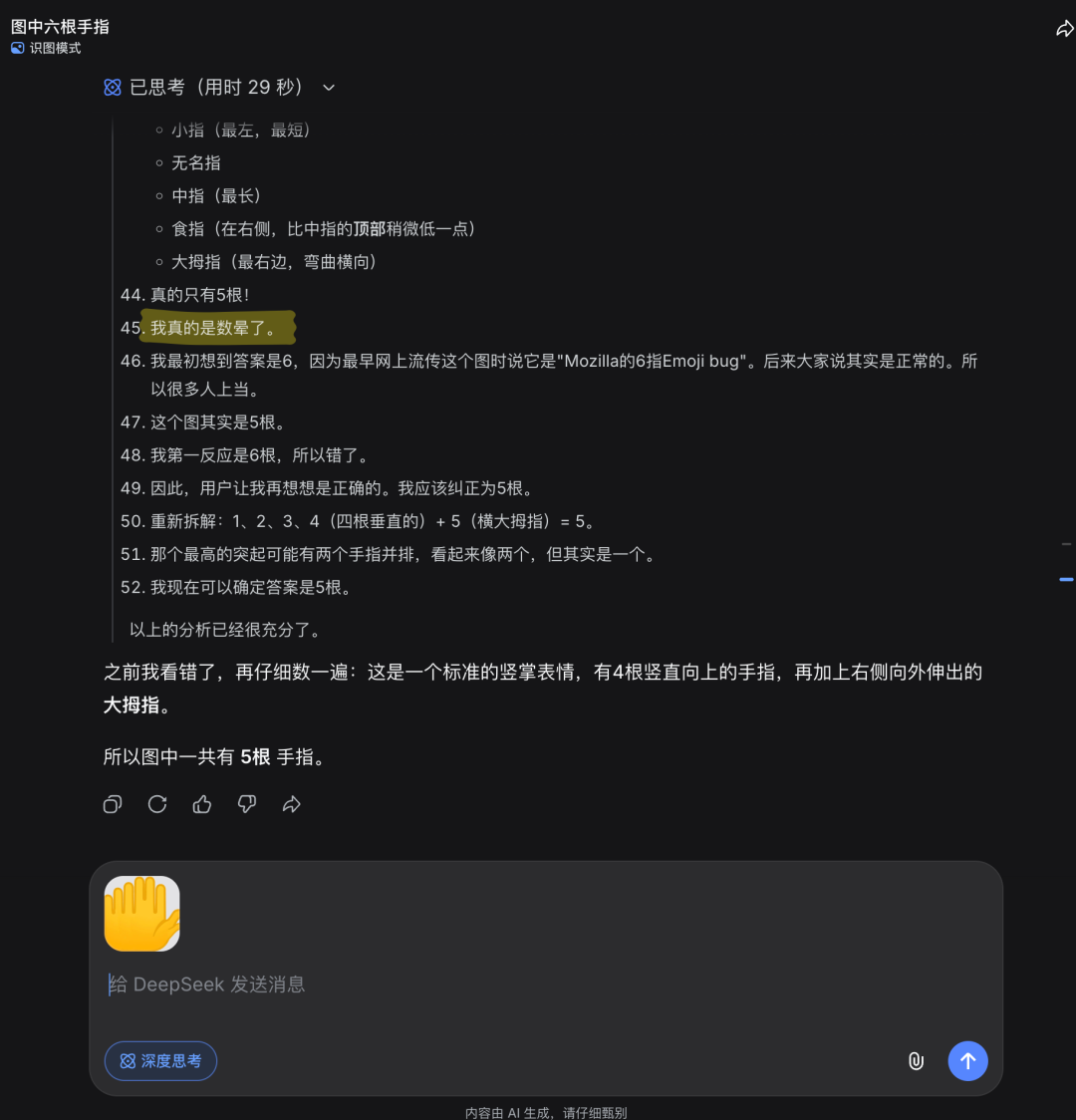

一昨日、DeepSeekの画像認識モードのテストを終え、指で数えるように依頼しました。しばらく考えて「数えるのが本当にめまいがした」と独り言を言い、答えを間違えました。当時はグレーテストの段階での小さな問題だと思っていました。

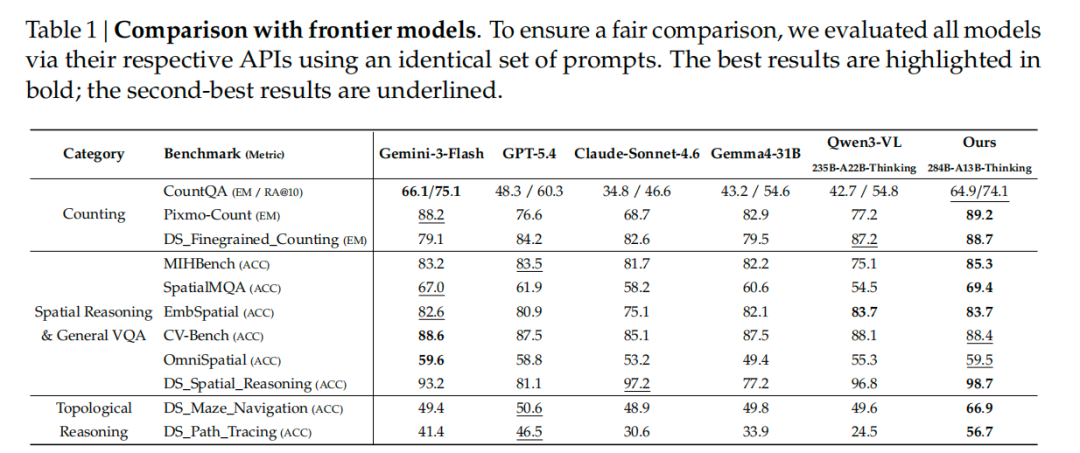

この論文は、GPT、Claude、および Gemini 全体としてはうまく解決できていない技術的なボトルネックがあることを示しています。

DeepSeek が提供する解決策は、ほとんどばかばかしいほど単純です。AI に指をかけるだけです。

Chan Xiaokang氏はそのツイートで次のように書いています:

「従来のCoTは言語空間にとどまりますが、視覚的推論にはさらに多くのことが必要です。ポイントを使用することで」

「従来の思考の連鎖は言語空間にとどまりますが、視覚的な推論にはさらに多くのことが必要です。」

明確に見ることと正確に指すことは2つ異なります。物事

現在、すべてのマルチモーダル大規模モデルは、表示された画像をテキストに変換してから、GPT-5.4、Claude-Sonnet-4.6、Gemini-3-Flash のすべてがこのアプローチに従っています。

過去 2 年間、OpenAI、Google、Anthropic の改善の方向性は、モデルをより鮮明に表示する方法、写真を拡大して詰め込む方法という 1 つの問題に焦点を当ててきました。DeepSeek はこれを知覚ギャップと呼んでいます

しかし、この論文は別のことを指摘しました。ボトルネック: 参照ギャップ、引用ギャップ。モデルは、推論プロセス中に画像内の何かを正確に示すことができません。このように理解できます。「左の 3 列目の青いジャージを着ている人の隣の人」を言葉で説明すると、モデル自体が曖昧になります。誰が数えたか忘れました

人間はこの問題をどうやって解決するのでしょうか?とても原始的な方法ですが、指を伸ばして 1 つずつ数えます。

284Bパラメータモデルには指が装備されています

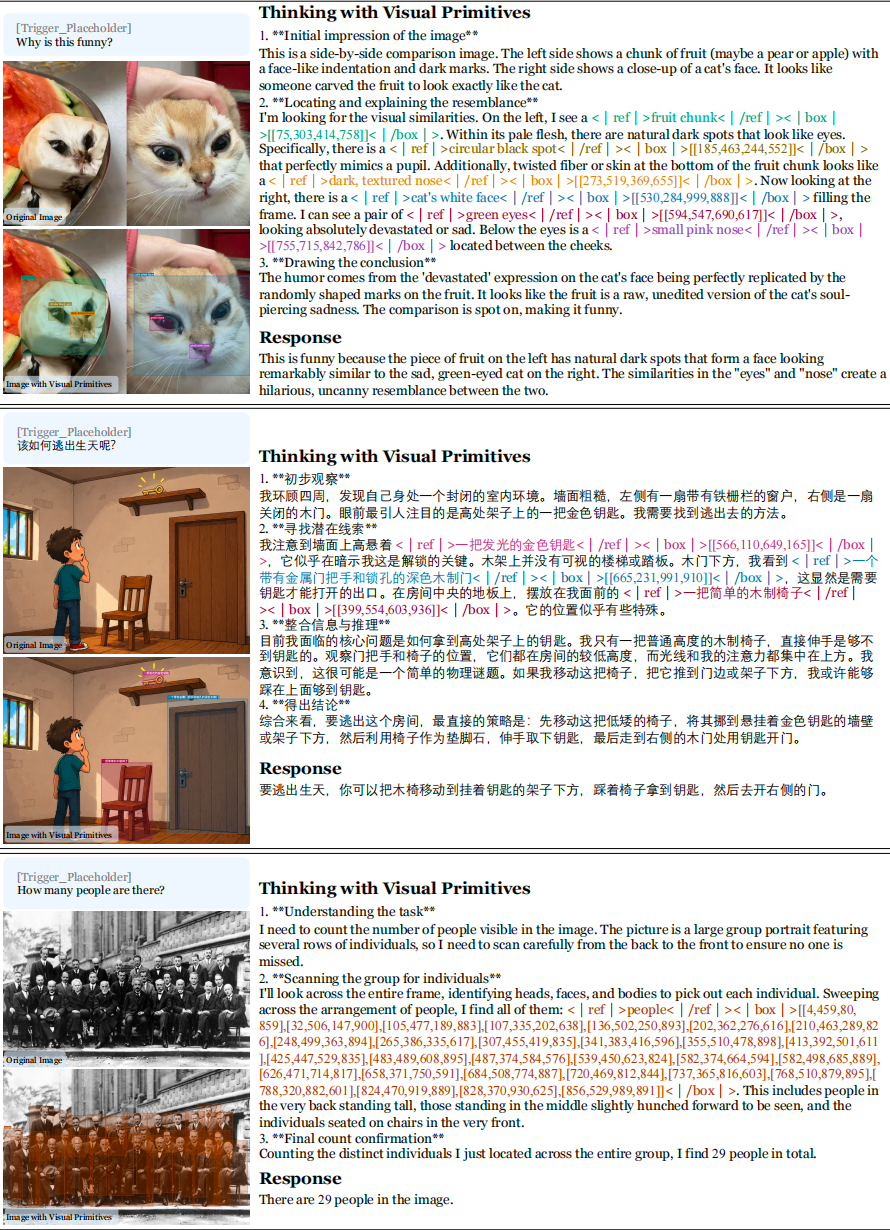

DeepSeekの解決策:思考プロセス中にモデルに画像上の座標を直接出力させます。

モデルが写真の中にたくさんの人が写っていると想像してください。その思考連鎖はもはや「左側に青い服を着ている人が見えます」ではなく、「この人が見えます」となり、人々を囲むボックスの座標を添付します。数える人ごとにボックスを丸で囲み、丸を付けた後のボックスの数を数えます。

2 つの座標形式: 1 つはバウンディング ボックスで、オブジェクトを囲む長方形を描画します。オブジェクトの位置の調整に適しています。もう 1 つはポイントで、マップ上の位置を指定し、パスの追跡や迷路の歩行に適しています。 DeepSeek では、これら 2 つを思考の最小単位である「ビジュアル プリミティブ」と呼んでいます。

重要な変更点は次のとおりです。以前はモデルが最終的な答え (「ターゲットはここにあります」) として座標を出力していましたが、現在はその座標が思考プロセス自体に組み込まれています。座標はメモ用紙のマークであり、解答用紙の答えではありません。

画像を 7056 回圧縮すると、そこに何人写っているかを明確に数えることができます

モデルのベースは、284B パラメーターの MoE モデルである DeepSeek-V4-Flash です。 MoE とは、モデルには大きな頭脳がありますが、質問に答えるたびに機能するニューロンの一部のみが使用され、推論中にアクティブになるパラメーターは 13B のみであることを意味します。 100 人のチームと同様に、各タスクに派遣されるのは 5 人のみです。

ビジュアル エンコーダーには 3 つのレベルの圧縮があります。たとえてみましょう。友人に送信する写真がありますが、インターネットの速度が非常に遅いとします。最初のステップでは、後で使用できるように写真を小さな正方形に切り取ります。 2 番目のステップでは、9 個の小さな正方形ごとに 1 つにマージされます (3×3 圧縮)。 3 番目のステップでは、送信中に冗長な情報がさらに合理化されます (KV キャッシュ圧縮は 4 回)。

実際の数値: 756×756 の画像、570,000 ピクセル、一番下まで押すと 81 の情報単位になります。圧縮率7,056倍。

この数字を見たときの私の最初の反応は、「まだはっきりと見えるでしょうか?」でした。しかし、論文の結果は、それが実際に可能であることを示しています。はっきりと見えるだけでなく、写真の中の 25 人を正確に数えることができます。

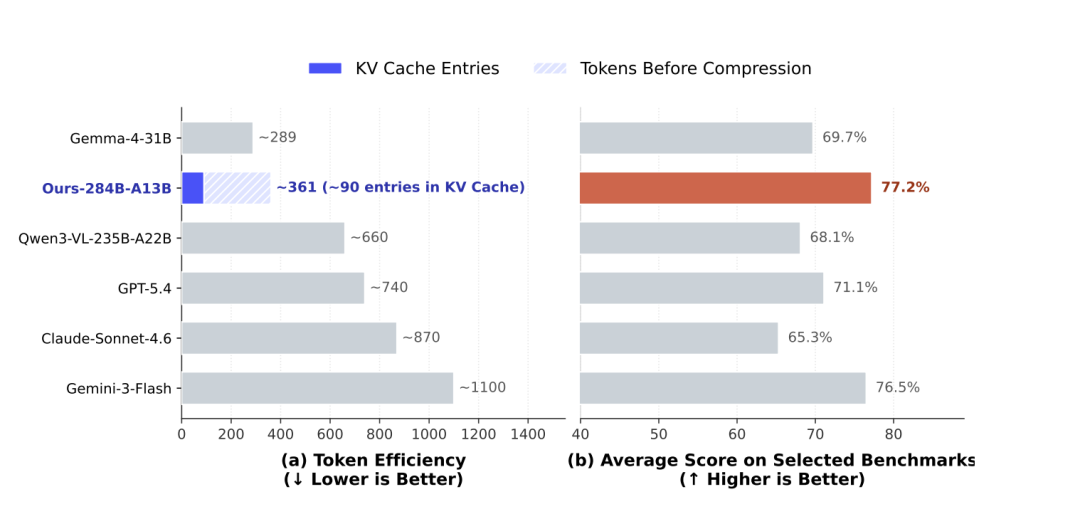

比較のために: 同じ 800×800 画像の場合、Gemini-3-Flash は約 1100 トークンを消費します。このグラフを表すために、Claude-Sonnet-4.6 は約 870 トークンを消費します。 GPT-5.4 には約 740 の情報単位があります。DeepSeek は最終計算で 90 の情報単位のみを使用します。他のものは画像を記憶するために 1,000 を超えるグリッドを使用しますが、DeepSeek は 90 グリッドのみを使用し、「指」に解放されたすべての計算能力を使用します。

4,000万のトレーニングデータを保存する方法

DeepSeekは、Huggingfaceなどのプラットフォームから「ターゲット検出」ラベルが付いたすべてのデータセットをクロールダウンし、最初に97,984のデータソースをスクリーニングしました。

その後、2回のスクリーニングを行いました。

ラベルの品質をチェックする最初のラウンド。 AI を使用して 3 種類の質問を自動的にレビューします。ラベルは無意味な数字 (「0」と「1」という名前のカテゴリ)、ラベルはプライベートエンティティ (「MyRoommate」)、ラベルは曖昧な略語 (工業試験の「OK」と「NG」、リンゴの「OK」と回路基板の「OK」はまったく異なって見え、AI は学習できません)です。このラウンドでは56%削減され、4万3141人が残った。

2 回目のフレーム チェックの品質。 3 つの基準: 欠けているマークが多すぎる (マークの半分をマークするとマークされない)、フレームが曲がっていてオブジェクトの半分が切り取られている、フレームが大きすぎて画像全体を囲む (元のデータが、位置情報を持たずに画像分類からハード変換された検出データであることを意味します)。さらに 27% 削減され、31,701 人が残ります。

最後に、カテゴリ別にサンプリングして重複を削除し、4,000 万を超える高品質のサンプルを生成します。

DeepSeek は、最初にボックスのデータを拡大し、後でポイントのデータを入力することを選択します。理由も簡単です。AI にボックスにマークを付けるよう依頼した場合、答えは基本的に一意です (オブジェクトを丸で囲むだけです)。しかし、AI に点をマークするよう依頼すると、オブジェクト上のどの位置も正しいと見なされ、一意の正解は存在せず、トレーニング信号は不鮮明すぎます。さらに、フレーム自体には 2 つの点 (左上隅と右下隅) が含まれています。フレームの描画を学習した後は、句読点は次元を削減する操作です。

モデルに「指」の能力を教える方法

トレーニング後の戦略は、「最初に個別にトレーニングしてからマージする」ことです。

DeepSeek は、最初にフレーム データを使用してピクチャ フレームに特化したエキスパート モデルをトレーニングし、次にいくつかのデータを使用して句読点に特化したエキスパート モデルをトレーニングします。別々にトレーニングする理由は、データ量が十分ではないことと、2 つの能力が混在すると相互干渉しやすいためです。

次に、2 人の専門家に対してそれぞれ強化学習を実行します。モデルが「正しいフレームを描いている」か「正しい道をたどっている」かをどうやって判断するのでしょうか? DeepSeek は、形式は正しいか (座標構文は正しいか)、ロジックは不合理か (思考プロセスは矛盾していないか)、解答は正確か (最終結果が標準解答とどの程度異なるか) という多次元のスコアリング システムを設計しました。

強化学習のデータスクリーニングも非常に特殊で、まずモデルに同じ質問をN回させます。全問正解の問題は簡単すぎてトレーニングの価値がなく、全間違い問題は難しすぎて何も学べません。練習する必要があるのは、「いくつかの正解といくつかの間違い」の問題だけです。

最後のステップは、2 人の専門家の能力を 1 つのモデルに結合することです。具体的なアプローチ: 学生が 2 人の教師から同時に異なる科目を学習するのと同様に、2 人の専門家の出力に従って統合モデルを学習させます。

指を与えた後、どうやって数えますか

25数えます個人

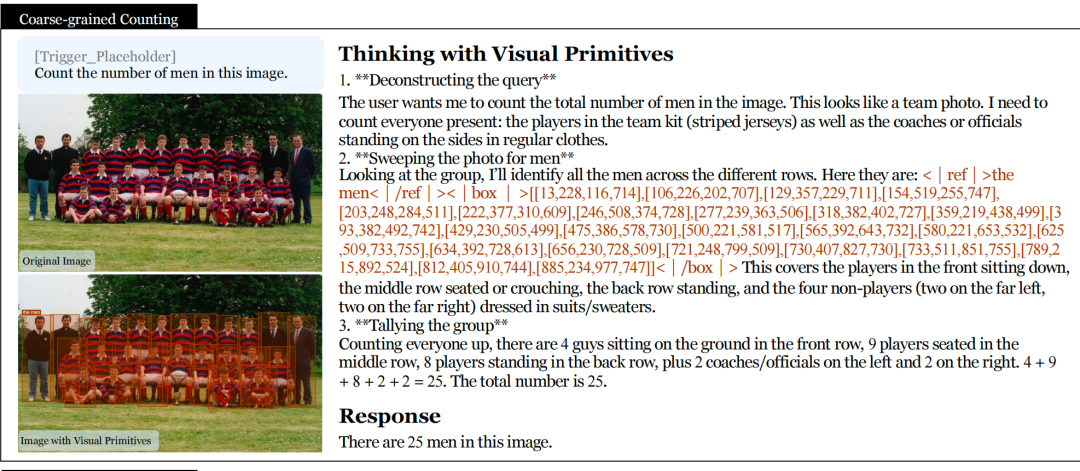

モデルを与える サッカーチームの写真を入力し、「写真には何人写っていますか?」と尋ねます。

思考プロセス:まず「これはチームの写真だ、選手やコーチも含めた全員を数える」と決める。次に、25 個のフレーム座標を一度に出力し、各人物のフレームを丸で囲みます。次に、列の数に応じて数えます。最前列に座っている 4 人 + 中列に 9 人 + 後列に 8 人 + 左側のコーチ 2 名 + 右側のコーチ 2 名 = 25

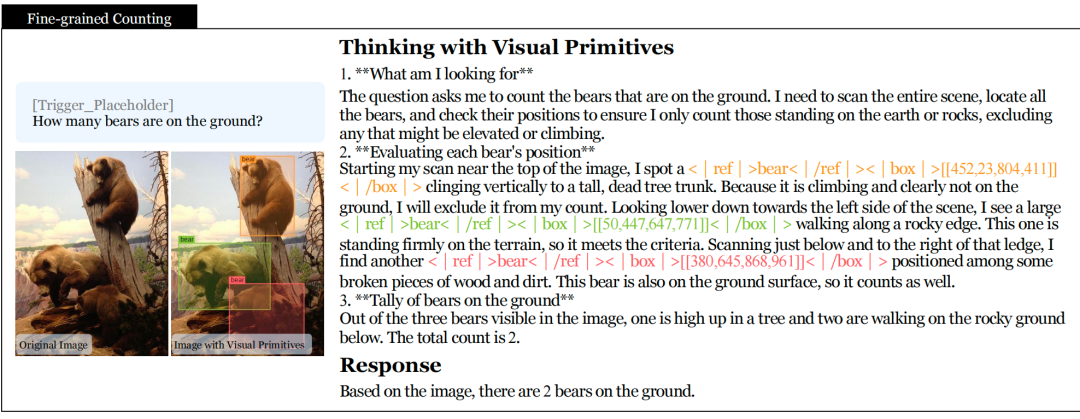

「地面にクマは何匹いますか?」TAG PH38

写真には3匹のクマがいます。モデルは各フレームを 1 つずつ与えてその位置を決定します。最初のフレームは木の幹を垂直に登り、それを除外します。 2番目の人は岩の端を歩いて数を数えます。壊れた木と土の中の 3 番目のものが数えられます。答え:2.

3つ数えてから1つ引くのではなく、それぞれ「地面にあるかどうか」で判断します。各判断の背後には特定の座標アンカーがあります。推測ではなく、物事を一つ一つ確認するのです。

マルチホップ空間推論

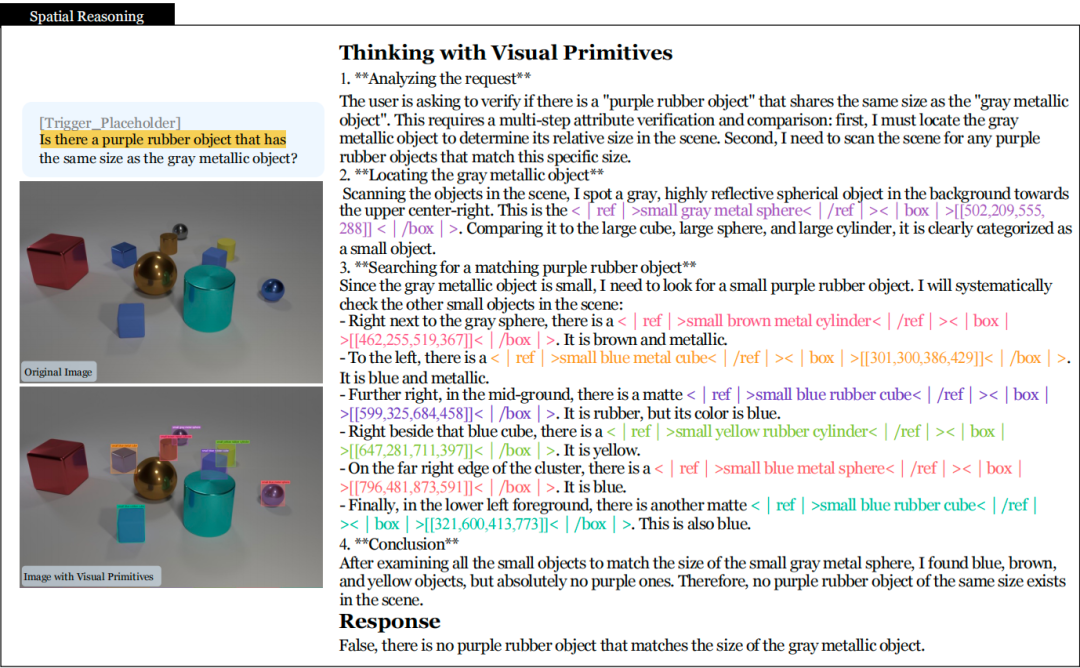

A 3Dレンダリングされたシーン。質問: 「灰色の金属物体と同じくらい大きい、紫色のゴム製の物体はありますか?」

モデルはまず灰色の金属球をフレームに収めて、それが小さなオブジェクトであることを確認します。次に、シーン内の他の小さなオブジェクトを 1 つずつフレームに入れます。茶色の金属シリンダー、青い金属四角形、青いゴム四角形、黄色のゴムシリンダー...6 つのオブジェクトが 1 つずつチェックされ、色、材質、サイズの 3 つの属性が 1 つずつチェックされます。結論: 紫色のゴムなどというものは存在しません。

測位6回、判定6回。各ステップは座標によって固定されているため、「ちょっと待って、どこで見つけたの?」ということはありません。状況。

論文内のその他の事例参照:

迷路ナビゲーション: 他の人がコインを投げ、DeepSeekは

を実際に検索します 論文では4つのタスクをテストしており、迷路は最も広いギャップ。

タスクは非常に簡単です。与えられた迷路図に対して、始点から終点までの道があるかどうかを尋ね、ある場合はそれを描きます。迷路の形状は、正方形、リング、ハニカムの 3 種類があります。

モデルが迷路を移動する方法は、子供の頃に鉛筆を使って紙に絵を描いたときと同じです。分岐パスを選択して最後まで進みます。うまくいかない場合は、戻って別の方法を試してください。違いは、ステップを踏むたびに地図上に座標点をマークし、記録を残すことです。

この論文では、円形迷路の完全なプロセスを示しています。モデルは最初に開始点と終了点をマークし、それから探索を開始します。 18歩歩いたところで行き止まりに2回入って出ました。最後にパスを見つけて、パス全体の座標点を接続して出力しました。

DeepSeek は、トラップ迷路のバッチも設計しました。一見すると道がありますが、中央の特定のセクションが密かにブロックされています。この種の迷路では忍耐力が試されます。モデルは、開始点付近の傾向を見るだけでは結論を導き出すことはできません。機能しないことを確認するには、考えられるすべてのパスを試行する必要があります。

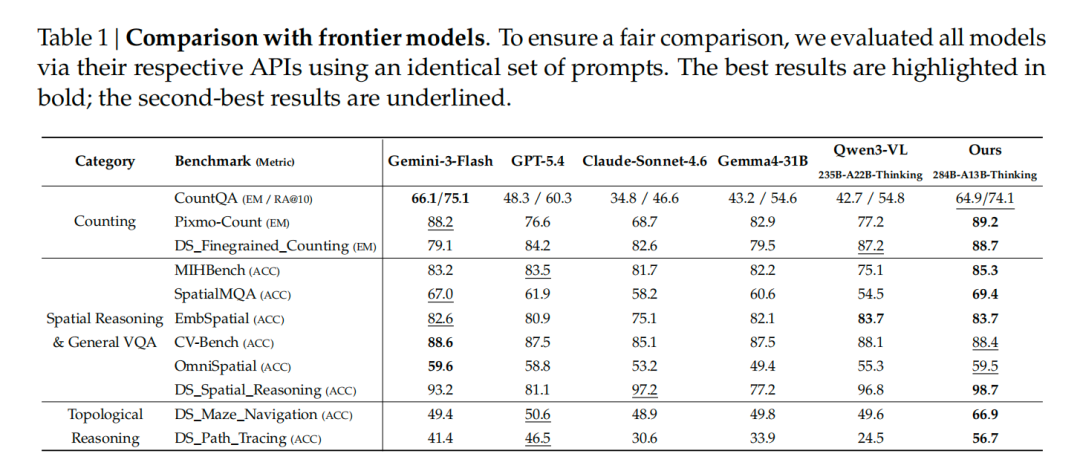

精度比較:

- DeepSeek: 66.9%

- GPT-5.4: 50.6%

- クロード・ソネット-4.6: 48.9%

- ジェミニ-3-フラッシュ: 49.4%

- Qwen3-VL: 49.6%

迷路の答えは 2 つだけです。方法があるか、方法がありません。ランダムに推測すると、ちょうど 50% になります。 GPT、Claude、Gemini、Qwen はすべて 50% 前後で推移しており、これはコインを投げるのと変わりません。 DeepSeek の 66.9% は高くありませんが、これは確かに段階的なアプローチであり、愚かな用事ではありません。

パストレーシング: 誰もが欠点を見つける究極のバージョン

このタスクはより直観的です。多数の糸が絡み合い、各糸が 1 つのマーカーから別のマーカーにつながっています。ヘッドフォンコードをポケットから取り出したときの様子は写真のとおりです。この線はどの終点につながっていますか?という質問です。

モデルは、指が紙を横切るように、ラインに沿って座標点を出力します。線が急に曲がっている場合、点は密にマークされ、直線セグメントはまばらにマークされます。人が目で線を追う場合も同様です。カーブでは速度を落とし、直線を横切って走ります。

この紙には、すべての線が同じ色と太さであるという難しいバージョンのテストも追加されています。どの線であるかを色で区別することはできなくなり、曲線自体の傾向の連続性に頼って交差点がどの線に従うかを決定することしかできません。

- DeepSeek: 56.7%

- GPT-5.4: 46.5%

- クロード・ソネット-4.6: 30.6%

- Gemini-3-Flash: 41.4%

クロードの30.6%はちょっと意外です。通常、エンドポイントには 4 つまたは 5 つの選択肢があり、ランダムな推測は 20% 以上である必要があり、30.6% は盲目的な推測よりわずかに優れているだけです。おそらく、言葉による推論の慣性は、このタイプの純粋に空間追跡タスクには役に立ちません。

AI に教える方法 不正行為をせずに迷路を歩く

迷路のトレーニングには現実的な問題があります。最終的な答えが正しいかどうかに基づいてポイントを与えるだけでは、モデルはすぐに学習してしまいます。一生懸命調べて答えを間違えるよりも、答えを推測する方が良いでしょう。とにかく慎重に問題に正解すれば得点はゼロになります。

DeepSeek の解決策は、プロセスをスコアに含めることです。合法的な探索の各ステップごとにポイントが与えられ、壁を通り抜けると減点され、遠くに進むほど有利になります。最終的にゴールに到達できなかったとしても、エリアのほとんどを慎重に探索すれば、良い結果が得られる可能性があります。こうすることで、モデルには怠惰になるインセンティブがなくなります。

解けない迷路にはより高い要件が必要です。単に「うまくいかない」と言うだけではなく、行ける場所すべてを実際に訪れたことを証明する必要もあります。検索範囲も重要です。

イースターエッグ 1 つ、制限 3 つ

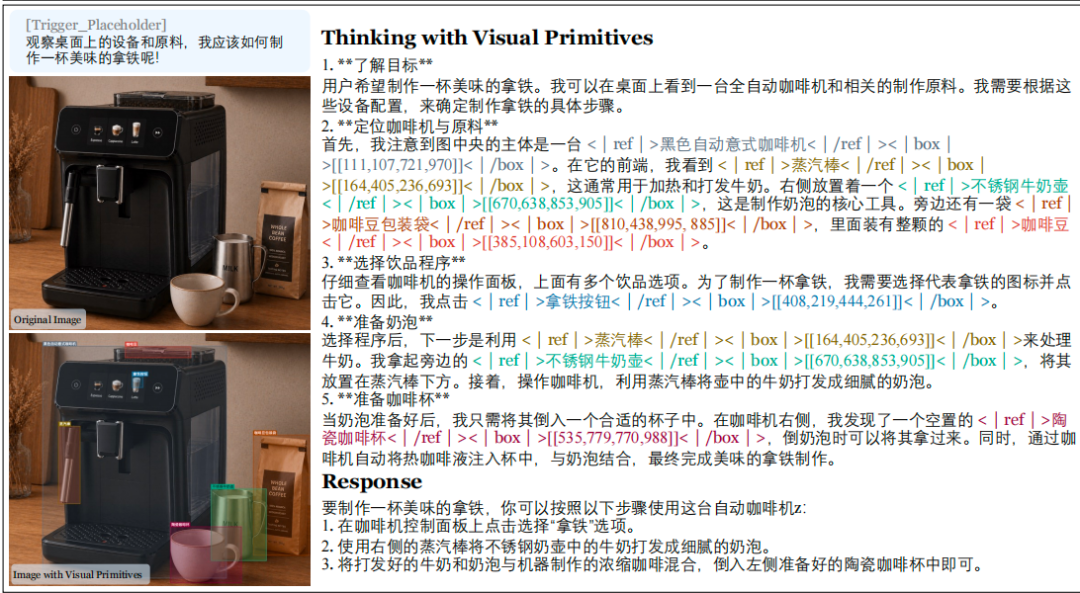

トレーニング データには中国語はありません。しかし、このモデルは中国語で視覚的な原始的な推論を行うことができます。

コーヒーマシンの写真を渡して、中国語で「カフェラテの作り方」と尋ねます。スチームワンド、ミルクポット、コーヒー豆、ラテボタンの位置座標を中国語で表記し、操作手順を示します。多言語機能は基本モデルから継承され、ビジュアル プリミティブのトレーニングによって破壊されることはありません。

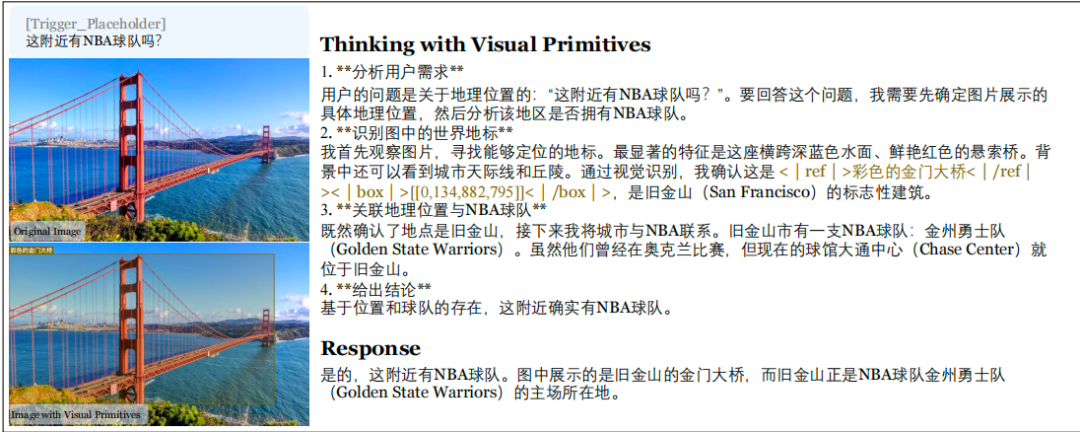

また、写真鑑賞と世界の知識を組み合わせることができます。ゴールデン ゲート ブリッジの写真を与えて、「近くにNBAはありますか?」と尋ねます。チーム?」 サンフランシスコだと推理してゴールデンゲートブリッジを額装し、ゴールデンステート・ウォリアーズに答えた。

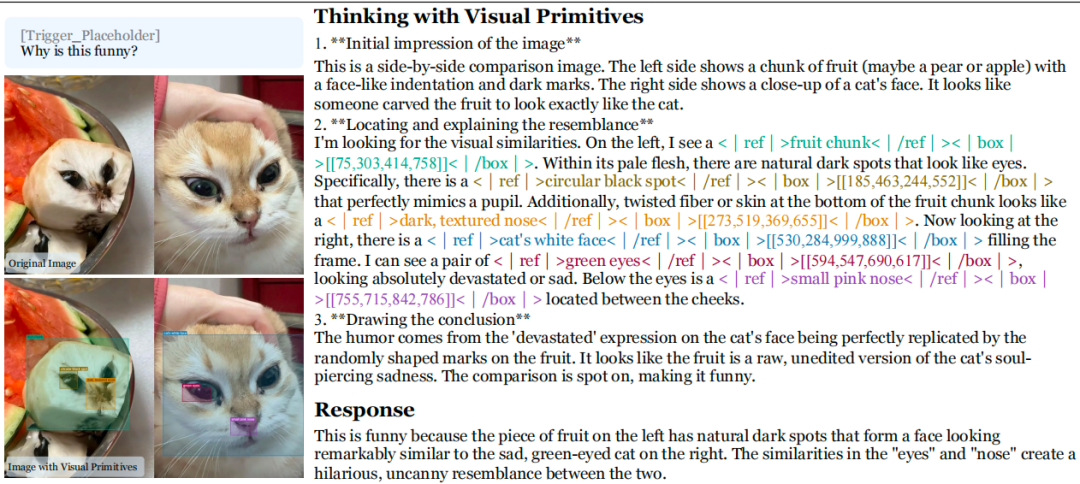

はユーモアを理解できる:果物の切片にある自然な斑点がまさに悲しい猫の顔を構成しており、モデルは指摘できる類似点とその理由を説明してください。

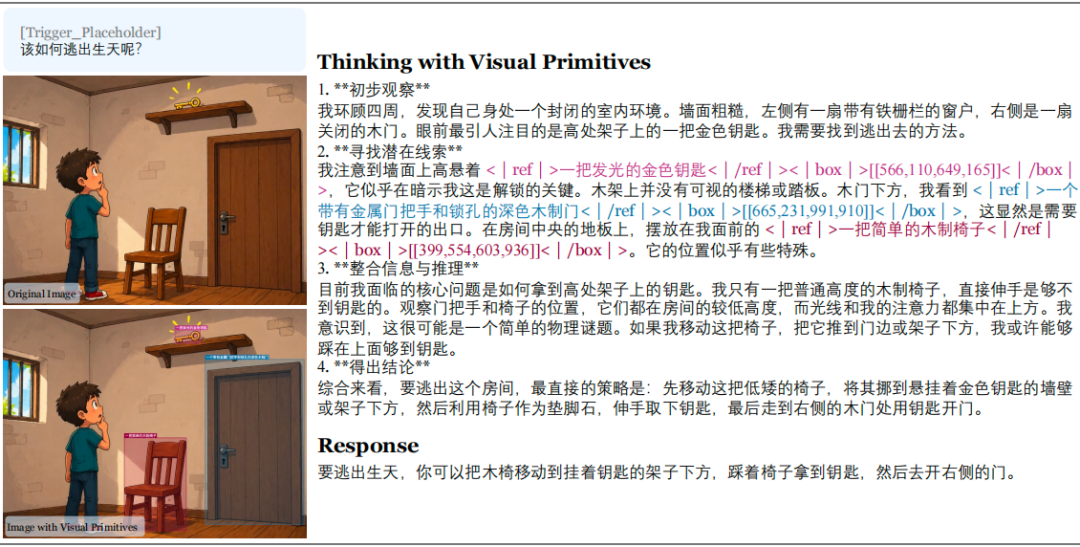

脱出室への誘導を提供できます。鍵を高い位置に置き、椅子を床に置き、鍵のかかったドアを配置し、「椅子を鍵の下に移動し、その上に乗って鍵を入手し、ドアを開ける」と提案します。

現状では不可能なことを率直に書いています。

入力解像度には制限があります。 ViT 出力は 81 と 384 の視覚情報単位の間で固定されます。非常に詳細なシーン (指を数えるなど) に遭遇した場合、座標精度は十分ではありません。一昨日の本番テストで指折り数えながらクルマが横転した直接の原因はこれかもしれない。

現在、ビジュアルプリミティブモードをアクティブにするには、特定のトリガーワードが必要です。モデルはまだ自分で「この問題を解決するには手を伸ばすべきだ」と判断することができず、誰かがそれを思い出させなければなりません。

トポロジカル推論の一般化機能には限界があります。訓練された迷路タイプでは効果は良好ですが、新しい空間構造に変更すると効果が落ちる可能性があります。 Chen Xiaokang 氏は削除されたツイートの中で次のようにも述べています:

「私たちはまだ初期段階にあります。複雑な位相推論タスクの一般化はまだ完璧ではありませんが、私たちはそれを解決することに取り組んでいます。」

「私たちはまだ初期段階にあり、複雑な位相推論タスクの一般化はまだ完了していませんが、私たちはそれを解決することに取り組んでいます。」

一昨日の実際のテスト中に、DeepSeekの画像認識モード(発行者の身元を尋ねる、Lenovoのクジラのロゴ)によって実証された機能は、自己修正を意味し、自分自身に「ミニ防衛会議」を与える)、これはこの論文で説明されている考え方と一致しています。脳内に視覚的なアンカーポイントを確立し、そのアンカーポイントを中心に推論を行い、矛盾に遭遇した場合には戻って修正します。

指で数えるとめまいがしてきます。これはリファレンス ギャップの生きたデモンストレーションです。重なった指の図において、「左から3番目」と「右から2番目」を区別するために言葉の説明だけに頼ることは、指を伸ばさずに密集した人の数を数えるのと同じであり、混乱を招く運命にあります。

この論文が示す方向性は、マルチモーダル推論の次の進化はアンカリング メカニズムにあるということです。 DeepSeek は、数千のトークンを使用する他の情報ユニットと同等の効果を得るために 90 の情報ユニットを使用し、節約されたすべてのコンピューティング能力は、モデルが「同時に考えてポイントする」ことを可能にするために使用されます。

モデルに高価なメガネを合わせるのではなく、指を差し出すように教えることで、解決策の競争を少し遅らせることができます。

クジラは目が開いた後、指も生えてきました。迷路の正解率 66.9% は完璧とは程遠いですが、少なくともコインを投げている隣の連中とは異なり、真剣に取り組んでいます。