NVIDIA は、次世代 AI フラッグシップ プラットフォーム Vera Rubin の立ち上げを加速しています。最新のニュースによると、このプラットフォームは早ければ今年7月にも北米の主要なクラウドサービスとAI顧客への出荷が開始され、2026年後半には完全な量産に入る予定だ。Vera Rubinがその設計と仕様に問題があるという以前の噂は、新しい生産と出荷スケジュールによって基本的に否定された。

数日前、Vera Rubin の設計と仕様における調整の可能性、さらには問題についてのニュースが業界で広まりました。これは、Blackwell GPU サーバーがリリース前に遭遇した混乱に似ていると言われていました。しかし、サプライ チェーン パートナーとの次世代 AI ラックおよびサーバーの納入で蓄積された経験に頼って、Nvidia は量産前に技術的欠陥を迅速に解決できる能力を再び実証しました。台湾の「経済日報」が業界チェーン筋の情報を引用して報じたところによると、NVIDIAはODMパートナーと協力してVera Rubinの最終量産バージョンを完成させ、明確な導入リズムを確立したという。

このレポートによると、Nvidia は今年 6 月に Vera Rubin プラットフォームの試作を開始し、その後 7 月からサーバーの最初のバッチが北米の複数の大手クラウド サービス プロバイダーと AI データセンターの顧客に出荷される予定です。最初の顧客リストには、Microsoft、Google、Amazon、Meta、Oracle が含まれます。 Nvidia は、来たる Computex 2026 の基調講演で、Vera Rubin を中心としたクラウド大手との綿密な協力関係を強調する可能性があります。同報告書はまた、TSMCが今年初めにVera Rubinチップの量産を開始するために3nmプロセスを開始し、Foxconn、Quanta、Wistronなどのファウンドリパートナーが今年下半期から完全なマシンとフレームの生産を本格的に展開し、早ければ2026年の第3四半期には大規模な出荷を達成する予定であると述べた。

最終的な製品仕様に関する問題が解決するにつれ、Vera Rubin プラットフォームが大幅な設計または仕様変更を受ける可能性があるというこれまでの記述は、「事実と矛盾しているか、後に修正された初期の情報に基づいている」とみなされます。業界は、各 Vera Rubin AI サーバー ラックのコストが約 1 億 8,000 万米ドルに上ると見積もっています。このプラットフォームにより、世界の AI インフラストラクチャ市場における Nvidia の潜在的な浸透力は 1 兆米ドルのレベルに達すると予想されます。これにより、利益率が大幅に拡大するだけでなく、ストレージやメモリのサプライヤーを含むパートナーに新たな成長の勢いがもたらされます。

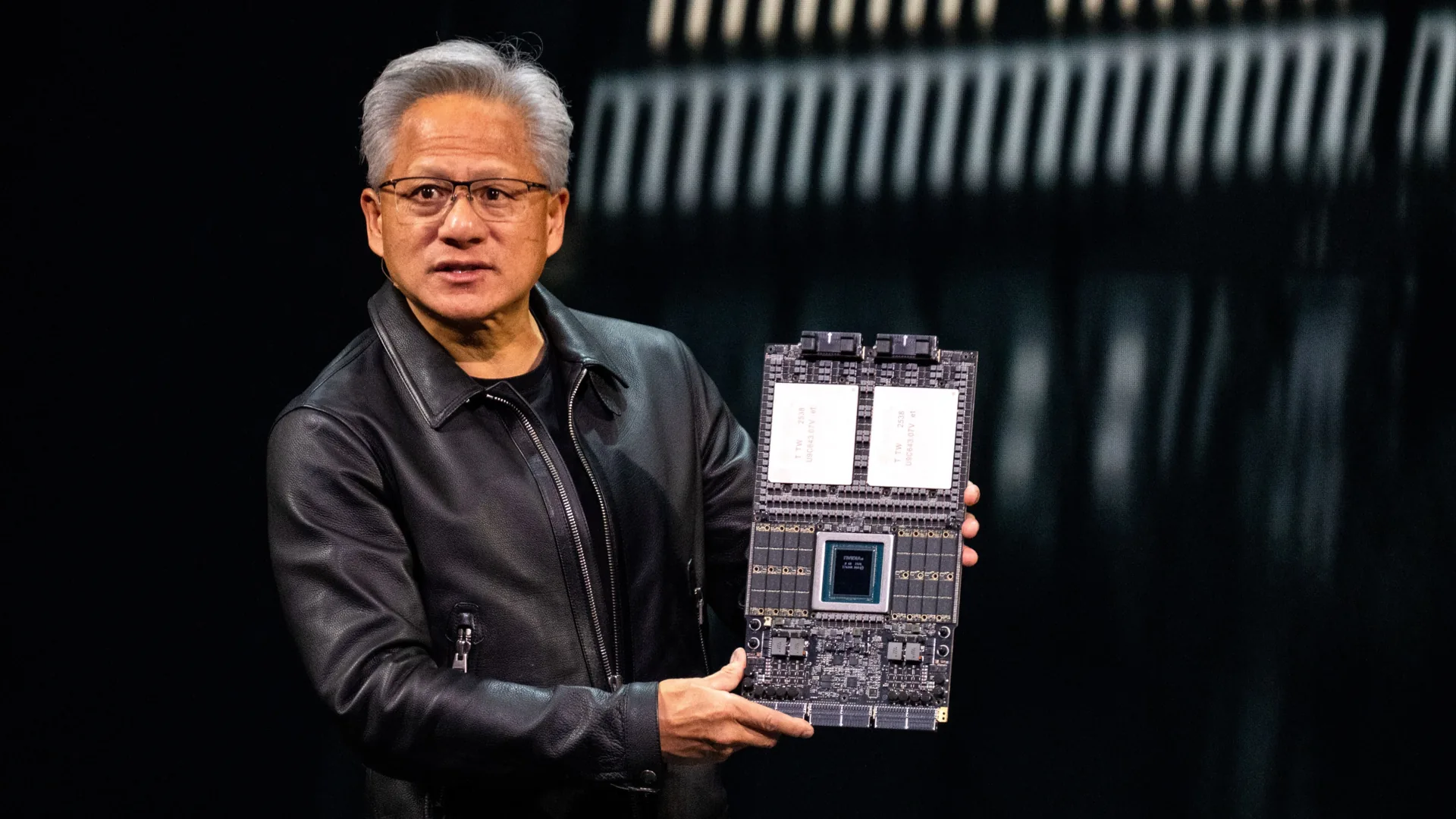

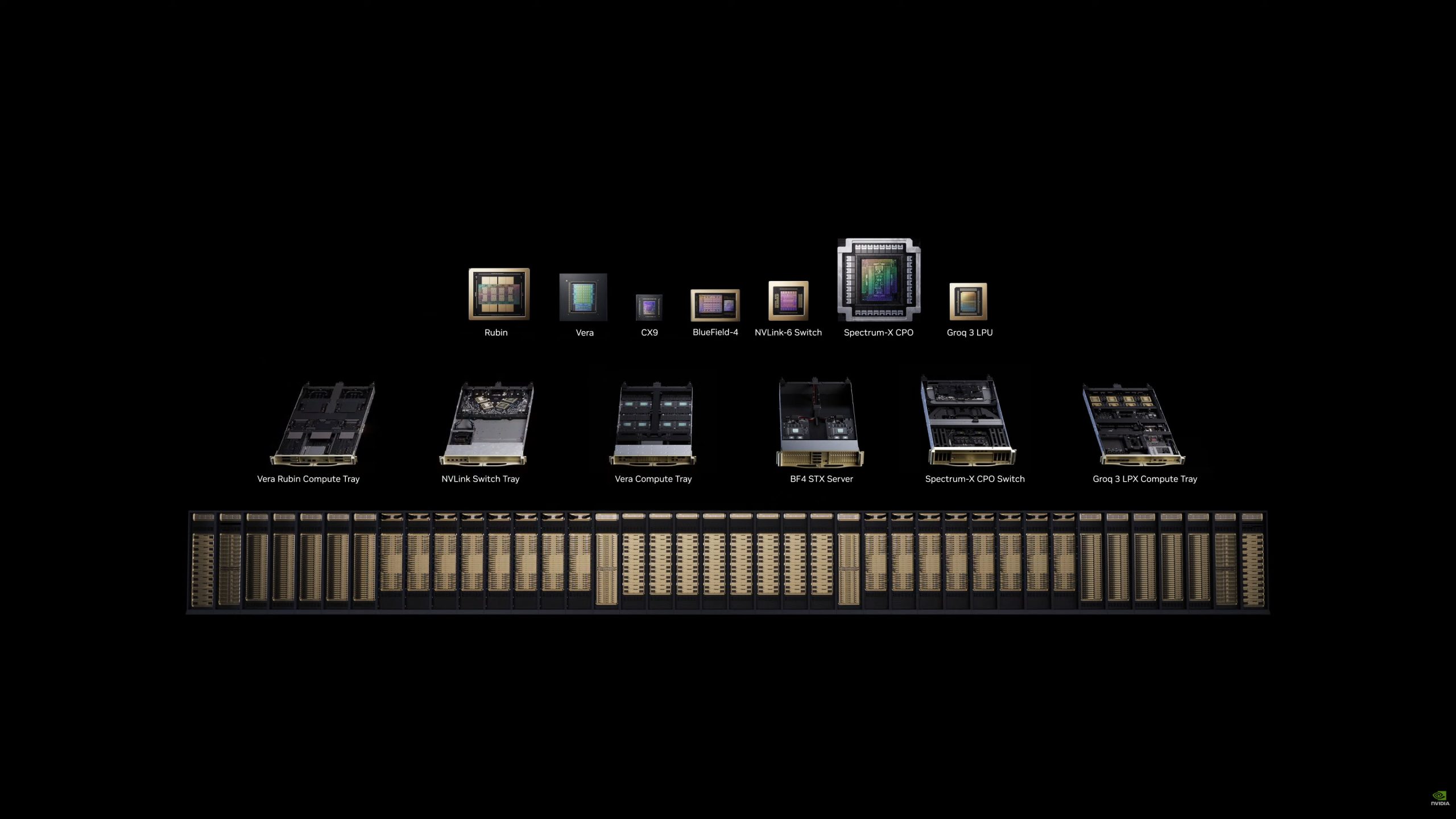

Vera Rubin プラットフォームでは、チップとメモリのエコロジーが同時にアップグレードされています。パートナー メーカーは、Rubin GPU 用の新世代 HBM4 高帯域幅メモリを導入することを計画しており、同時に、大規模モデルのトレーニングと推論における帯域幅と容量に対するますます厳しくなる要求を満たすために、CPU 側で最大 256GB の容量を持つ SOCAMM2 LPDDR5X ソリューションを提供する予定です。ハードウェア アーキテクチャ レベルでは、Vera Rubin は 7 つのチップで構成され、強力なソフトウェア スタックによってサポートされる複雑なプラットフォームとして説明されています。一時的には業界で他の追随を許さないと考えられています。 Nvidia は、Vera Rubin を活用することで、今後 10 年間でコンピューティング能力の出力が現在のレベルの 4,000 万倍に増加する見込みであると発表しました。以前のテクノロジー プレビューから判断すると、業界は一般的に、このプラットフォームが AI コンピューティング能力に新たな飛躍をもたらすと期待しています。

スケジュールから判断すると、ベラ・ルービンは噂や不確実性から脱却し、実質的な試作と出荷の段階に入りつつある。ラックの最初のバッチが 7 月に北米のクラウド サービス プロバイダーのデータ センターに到着し、台湾の OEM が今年後半に本格的な量産に入る中、Vera Rubin は AI インフラストラクチャ競争の次の段階で NVIDIA の中核を担うことになるだけでなく、世界のクラウド コンピューティングと AI 業界の状況にも大きな影響を与えるでしょう。