DeepSeek V4 がリリースされてからまだ 5 日しか経っていませんが、ほぼ毎日新しいアクションがあります。昨日、研究者たちはマルチモーダル機能が登場すると予測しましたが、今日、すでにグレースケールテストが行われています。多くの人は、DeepSeek Web ページに画像認識モードが追加されていることを発見しました。これは、画像情報を理解できることを意味します。この能力は AI のプログラミングや推論のパフォーマンスを直接向上させるものではありませんが、使用すると非常に便利になります。日常生活で問題が発生した場合は、スクリーンショットを直接アップロードして、DeepSeek が自動的に分析することができます。自分で問題を説明するよりも簡単です。

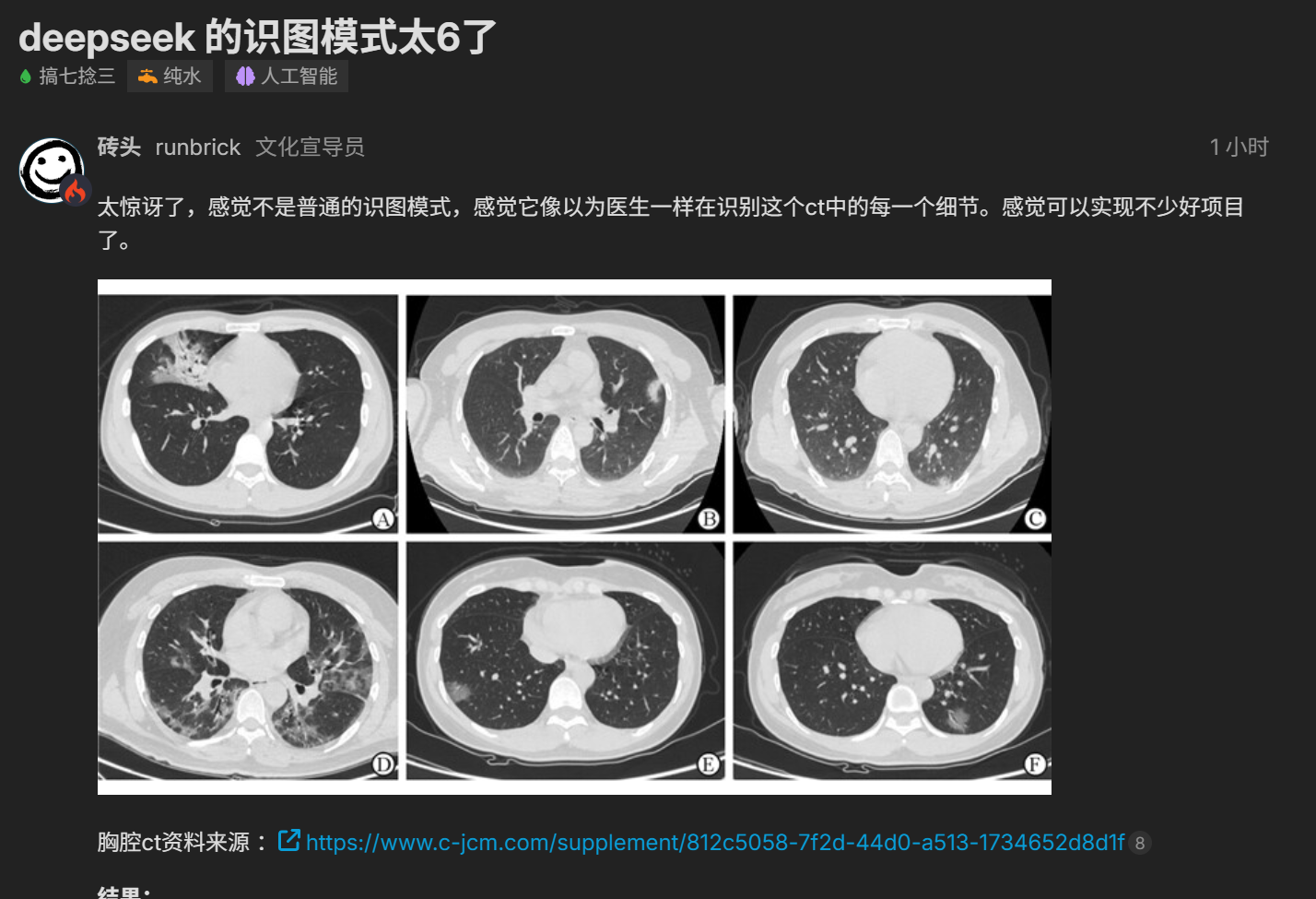

グレースケールに到達したネチズンもプロの画像情報を使用します。たとえば、病院で撮影したCT画像を使ってDeepSeekの画像認識能力を確認したのですが、その結果には衝撃を受けました。

Linux.do コミュニティのネチズンである @brick によってアップロードされた CT 画像は、専門論文からのものです。 DeepSeek による分析後、画像の内容を正確に判断し、専門的な分析を行うことができます。最終的にいくつかの結果が得られ、いくつかの異なるタイプの肺炎の可能性を含む、この病気についての可能性のある方向性が示されました。

この CT 画像がどこにあるかについては、論文の中で明確な結論が述べられています。比較すると、DeepSeek の分析は依然として非常に信頼性が高く、この点で AI ドクターの役割を担うことができることがわかります。

しかし、やはりAIはAIです。誰もが状況を分析するのに役立ちます。このような大規模な健康診断や病気の確認には、病院や医師による分析と確認が必要です。

深刻な病気でない場合は、実際に AI を使用して一般的な医学的問題の医師になることができます。大規模な専門的な医療モデルによってトレーニングされた AI アプリケーションも多数あります。問題を判断し、問題が発生したときに提案を提供するためにそれらを使用するだけで十分です。小さな問題のために病院に行ったり、行列に並んだりする必要はありません。

DeepSeekの話に戻りますが、彼らは以前にもマルチモーダルな研究を行っており、オープンソースのOCR技術は世界トップレベルにまで達しています。したがって、DeepSeek V4 大型モデルの機能範囲と使用制限をさらに改善できるビジュアル機能にも期待がかかります。