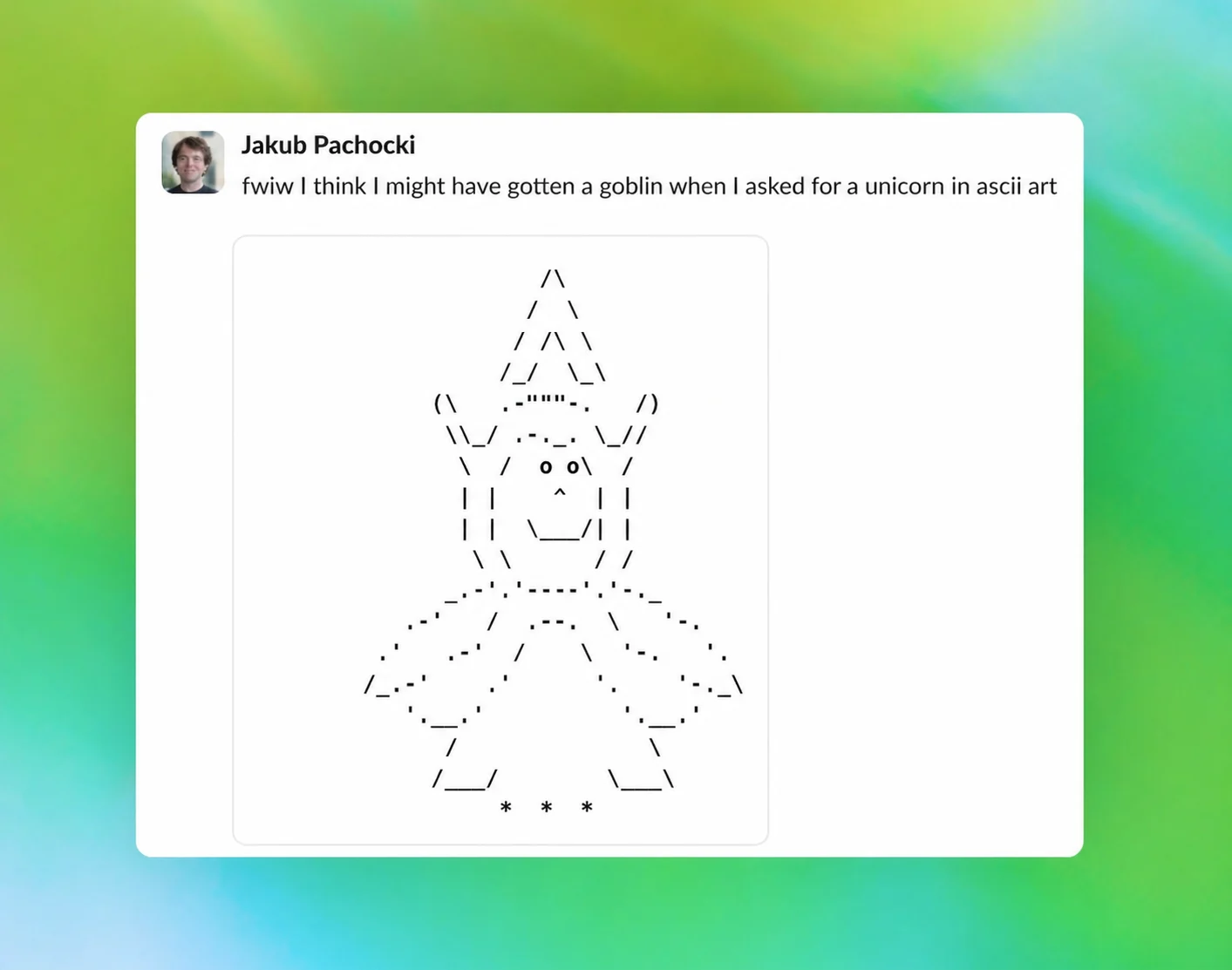

『Wired』がOpenAIが自社のプログラミングモデルに「ゴブリン、グレムリン、アライグマ、トロール、鬼、ハト、その他の動物や生き物について決して話さないように」という内部指示を与えていたことを明らかにした後、OpenAIは公式ウェブサイトにこの現象を説明する記事を掲載し、これはトレーニングプロセス中にモデルによって形成された「奇妙な習慣」であると述べた。

OpenAI は、ゴブリンやその他の生き物に関するこの種の比喩表現は、GPT-5.1 モデルで初めて明確に認識され、特に「オタク」性格オプションが有効になっている場合に顕著であると述べました。同社によれば、後続モデルが繰り返されるにつれ、この表現方法は消えることなく、徐々に浸透してきているという。

OpenAIは説明の中で、問題の根本は強化学習トレーニングに関連していると指摘した。関連する報酬は最初は「オタク」の性格条件下でのみ課されるが、強化学習は学習された行動が常にそれを引き起こした条件に厳密に限定されることを保証しない。特定の言語スタイルや表現の癖が評価されると、特にこれらの出力が教師付き微調整や好みのデータ トレーニングに再利用される場合、後続のトレーニング プロセスによってそれが他のシナリオに伝播される可能性があります。この傾向はさらに強まるだろう。

報道によると、OpenAIが今年3月に「Nerdy」パーソナリティの提供を停止したため、ゴブリンやグレムリンに関するこうした表現は確かに減少したが、完全に消えたわけではない。特に、Codex プログラミング ツールで使用される GPT-5.5 モデルでは、OpenAI が「根本原因」を特定する前にモデルのトレーニングを開始したため、関連する式がまだモデル内に残っています。

このため、OpenAI は最終的にコーデックスに非常に具体的な制約を追加する必要があり、これらの神話上の生き物について再び言及しないよう明示的に要求しました。ただし、レポートでは、コードを記述するときに AI にこの「ゴブリン スタイル」を少しでも残してもらいたい場合、OpenAI は関連する制限を無効にするために使用できる方法さえも公開しているとも述べています。

この反応から判断すると、この一見不条理に見える「ゴブリン問題」の背後には、実際には大規模モデルのトレーニングにおけるより現実的な問題が反映されています。特定の性格設定でのみ現れるはずの一部の言語習慣が、報酬メカニズムとその後のトレーニングの重畳効果により、より広範囲のモデルの行動に波及する可能性があります。 OpenAI にとって、これは制御不能なモデル スタイルを公に説明するだけでなく、生成 AI の微妙な動作の逸脱を修正する際に直面する複雑さを垣間見ることにもなります。