DeepSeek は、「Thinking with Visual Primitives (Thinking with Visual Primitives)」というタイトルのマルチモーダル推論モデルと技術レポートを GitHub 上に公開しました。 このモデルは、DeepSeek V4-Flash (合計 284B パラメーター、推論中にアクティブ化される 13B MoE アーキテクチャ) に基づいて構築されており、新しいマルチモーダル推論パラダイムを提案します。

この論文は、既存のマルチモーダル大規模モデルには無視されてきた根本的なボトルネックがあると指摘しています。それは「参照ギャップ」(参照ギャップ)、つまり、モデルは画像の内容を「見る」ことができますが、自然言語を使用して思考連鎖を構築する場合です。推論の過程で、中央付近の左側にある大きな赤い物体などのあいまいな説明では、密集したシーン内の視覚的オブジェクトを正確に特定できず、注意が逸れて誤った結論が導き出されてしまいます。

以前、学術コミュニティにおける主流の対応方向は知覚解像度を向上させることでしたが、この論文では、見えることと、何が言われているかを明確に伝えることができることは別のことであると考えています。

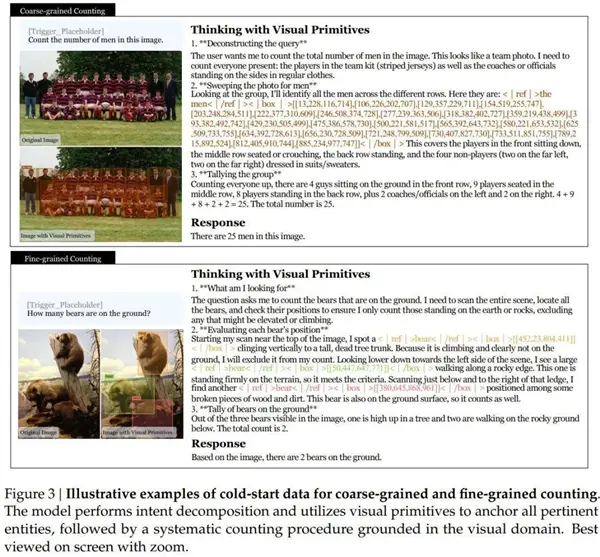

このモデルの中心的な革新は、推論プロセス自体に点座標と境界ボックスを埋め込み、それらを思考チェーンの基本単位にすることです。推論中にモデルが視覚オブジェクトに言及するたびに、その座標が同期的に出力されます。

たとえば、「木に登っているクマ[452, 23, 804, 411]を見つけて除外し、次に左を見下ろすと岩の端に立っている別のクマ[50, 447, 647, 771]を見つけ、条件を満たします。」座標はもはや、事後にマークされる答えではなく、推論プロセス中の曖昧さを排除するための空間アンカーです。

アーキテクチャレベルでは、モデルは7056倍の視覚圧縮、756×756の画像を達成します ViT処理後、2916個の画像ブロックトークンが生成され、324個にマージされました3×3 空間圧縮によるトークン。 KV キャッシュは、圧縮スパース アテンション (CSA) メカニズムによってさらに 4 回圧縮され、最終的に 81 個のビジュアル KV エントリのみが残りました。

参考として、同サイズの絵Claude Sonnet 4.6では約870枚、Gemini-3-Flashでは約1100枚必要となります。

トレーニング データに関しては、チームは約 100,000 のターゲット検出データ セットから約 31,700 の高品質データ ソースを選別し、計数、空間推論、迷路ナビゲーション、経路追跡の 4 種類のタスクをカバーする 4,000 万を超えるトレーニング サンプルを生成しました。

ポストトレーニングでは、最初に専門化、次に統合戦略を採用します。 2 つのエキスパート モデル、バウンディング ボックスとポイント座標は個別にトレーニングされます。強化学習の最適化後、オンライン ポリシー蒸留を通じて統合モデルにマージされます。

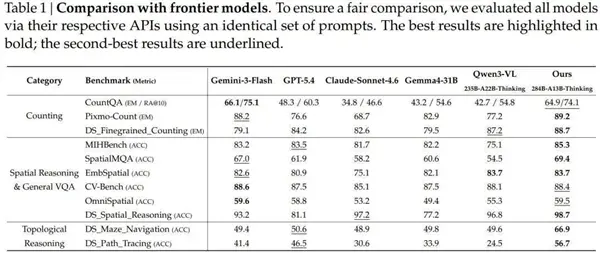

実験結果は、11 のベンチマーク テストで Gemini-3-Flash、GPT-5.4、Claude Sonnet 4.6 などの主流モデルと比較されました。

計数タスクでは、Pixmo-Countの完全一致スコアは89.2%で、Gemini-3-Flashの88.2%を上回り、大幅に上回っています。 Sonnet 4.6 の GPT-5.4 は 76.6%、Claude は 68.7% です。

最も代表的なギャップは位相推論に現れます。迷路ナビゲーション スコアは 66.9%、GPT-5.4 は 50.6%、Gemini-3-Flash は 49.4%、Claude Sonnet 4.6 は 48.9% で、約 17 パーセント ポイント増加しました。パス追跡スコアは 56.7%、GPT-5.4 は 46.5% です。

ただし、この論文では現在の限界も指摘しています。つまり、モデルは視覚的な原始的なメカニズムを有効にするために単語を明示的にトリガーする必要があり、非常にきめの細かいシーンでの座標精度には限界があり、シーン間の汎化機能にはまだ改善の余地があります。